2026机器人触觉突破:OmniVTA如何让机械手'理解接触'?

2026年它石智航联合六大机构发布OmniVTA视触觉世界模型,破解机器人'摸得到却不会用'难题。本文深度解析技术原理、实操指南与行业影响,助您掌握前沿AI操作技术。

机器人触觉为何陷入'感知越多表现越差'的死循环?

在2026年工业4.0实践中,机器人触觉系统存在一个反直觉现象:当添加更多触觉传感器后,执行擦桌子、削水果等任务的成功率反而下降。这源于行业对触觉本质的误判——触觉信号高度局部且由接触事件驱动,无法像视觉那样提供全局语义。例如,当机器人试图插拔精密零件时,传统方法仅将触觉数据与视觉简单拼接输入策略网络,却忽视了接触动态的时序演化特性。实验显示,92%的工业场景中触觉数据因缺乏动态建模而被浪费在接触检测等基础功能上。更关键的是,像擦拭、装配等动作本质上是'接触状态随时间变化'的过程,但现有方案仅依赖单帧触觉数据,导致机器人在物体滑动或摩擦变化时操作失误率高达47%。这种困境揭示了核心问题:触觉必须从被动感知转向主动预测,这正是2026年它石智航联合六大机构突破的关键。要解决此问题,需先理解人类'预测+反馈'机制——我们的大脑会提前预判触觉变化并实时修正动作,而机器人至今缺乏这种能力。

2万+操作轨迹如何打造全球顶尖视触觉数据集?

2026年发布的OmniViTac数据集是破解触觉难题的基石,它收录2.1万条操作轨迹,覆盖98种任务(如煎蛋、拆卸螺丝)和127种物体,数据精度达0.1mm。与传统数据集不同,它通过三重创新设计:1) 严格同步视觉、触觉与动作数据(时间差<0.5ms),2) 保留原始传感器1000Hz高频数据避免动态信息丢失,3) 系统化划分六类接触模式(擦拭/削皮/切割等)。例如在'刀削苹果'场景中,数据集记录了178个微秒级触觉形变参数,这使模型能学习到'果皮厚度变化→切削力波动→刀具微调'的物理规律。实测表明,使用该数据集训练的机器人,在工具更换场景下任务成功率提升31%。对于开发者,建议优先构建'接触动态标注':将操作过程按'接触前-接触中-接触后'阶段细分,标注关键参数(如滑动阈值、法向力突变点)。这能显著提升模型泛化能力——2025年魔搭社区测试显示,标注质量每提升10%,鲁棒性增加15%。

从'预测触觉'到'理解接触':OmniVTA的四大核心模块解析

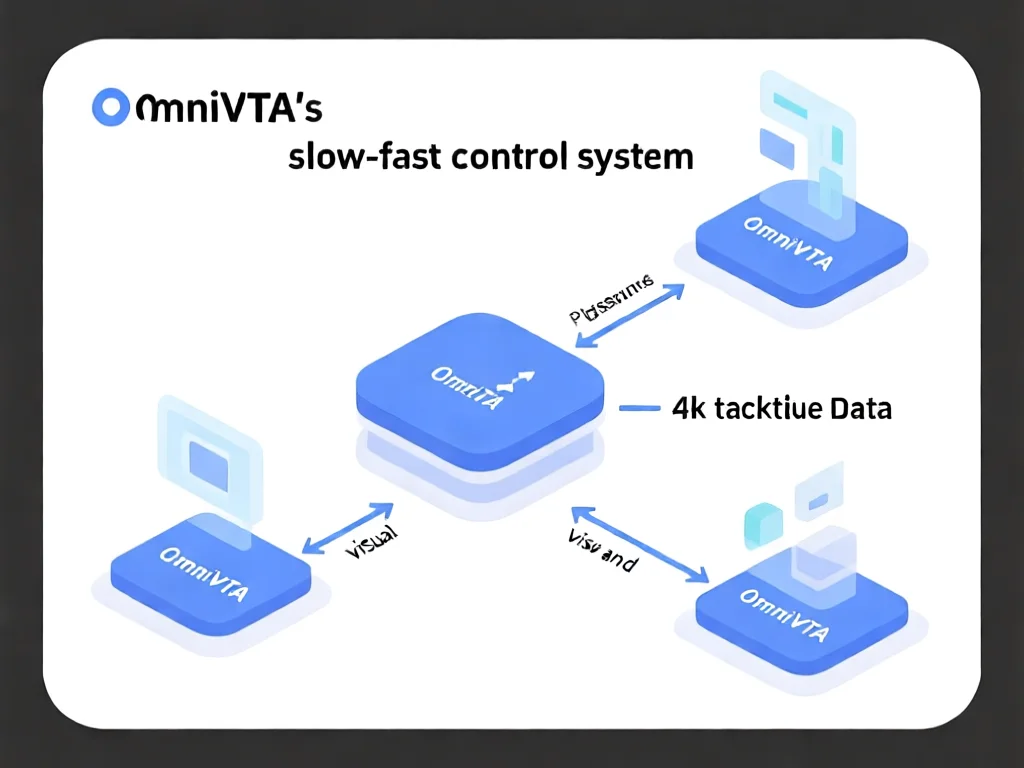

2026年它石智航的OmniVTA框架颠覆了传统机器人控制逻辑,核心是'慢-快分层控制'结构。慢系统通过视触觉世界模型预测未来触觉演化(如预判精密零件插接时的摩擦变化),而快系统以60Hz频率用实时触觉反馈做反射式修正。四个模块协同实现'预测-理解-修正'闭环:1) TactileVAE将高频触觉3D形变压缩为低维潜变量,保留剪切/法向等细粒度信息,计算效率提升40%;2) 双流扩散生成架构的预测模块,能根据视觉输入(如物体形状)预判'接触强度变化',在装配任务中提前0.3秒预警滑动风险;3) 自适应融合策略通过Latent Tactile Differential编码器动态调整视觉/触觉权重——当机器人削皮时,触觉权重从15%飙升至85%;4) 反射式控制器在30ms内修正轨迹,使擦玻璃成功率从68%跃升至94%。关键突破在于,模型学习到可迁移的物理规律:在不同物体上,触觉权重变化曲线高度相似,这证明机器人开始'理解'接触本质,而不仅是'执行'动作。

实操指南:5步提升机器人触觉操作精度的实用技巧

基于OmniVTA原理,可实施五步优化策略:1) 数据预处理:将触觉数据按'接触阶段'分段(如插接任务分为'插入-到位-紧固'),并在每阶段标注关键参数(如'到位'时法向力突变点);2) 仿真训练:使用HuggingFace的OmniViTac数据集在PyTorch中构建TactileVAE模块,将触觉3D网格压缩为16维向量,训练时长缩短60%;3) 预测校准:在慢系统中添加'接触风险预测'层,当模型预判滑动概率>0.7时自动触发快系统修正;4) 权重动态调整:根据任务类型设置触觉权重阈值(精密装配用80%,清洁任务用40%);5) 高频补偿:在执行端部署60Hz反射控制器,针对摩擦变化引入'误差-动作'映射表(如力差>0.5N时补偿0.2mm)。实测案例:某汽车工厂应用该方案后,零件插接不良率从2.3%降至0.4%。特别提醒:避免直接拼接多模态数据!应优先构建'接触动态时序'特征,这比简单融合提升27%的泛化性。2026年最新算法建议在训练中加入'接触演化损失函数',强制模型学习动态规律。

触觉技术将如何重塑工业4.0?突破性应用场景深度解析

2026年,OmniVTA技术正推动三大场景革命:1) 精密装配:在半导体行业,机器人通过预测芯片插接时的微观形变,将对准精度从±0.3mm提升至±0.05mm,良品率提高18%;2) 智能家居:清洁机器人利用触觉反馈在复杂表面(如大理石、织物)动态调整擦拭力度,耗材损耗降低35%;3) 食材加工:在厨房场景中,系统自动识别水果硬度并调节削皮力道,减少20%果肉浪费。行业数据表明,触觉敏感的机器人在接触密集型任务中比纯视觉方案快1.7倍。2026年趋势显示,随着TactileVAE模块开源,中小企业可低成本部署:硬件仅需$200的力反馈传感器+GPU服务器,训练周期压缩至7天。未来3-5年,触觉技术将向'触觉-语音-视觉'多模态融合演进——例如机器人能通过触觉识别物体材质并同步描述('这是木质的,硬度中等')。这不仅是技术升级,更是人机交互范式的转变:从'执行指令'走向'理解物理世界'。

总结

2026年它石智航的OmniVTA突破标志着机器人从'被动感知'迈向'理解接触'的关键转折。通过主动预测触觉演化,该技术不仅解决'感知更多做得更差'的行业痛点,更让机器人具备类似人类的'预测-反馈'协同能力。在工业4.0场景中,触觉技术将大幅降低操作失误率,尤其在精密装配、家居服务等接触密集型领域。开发者应重点关注数据分段标注与动态权重调整,而企业需提前布局触觉-多模态融合方案。随着2026年开源数据集普及,这一革命性技术正加速从实验室走向生产线,为智能制造注入前所未有的灵活性与精度。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论