2026年机器人突破:时间建模让AI'通古今知未来'全解析

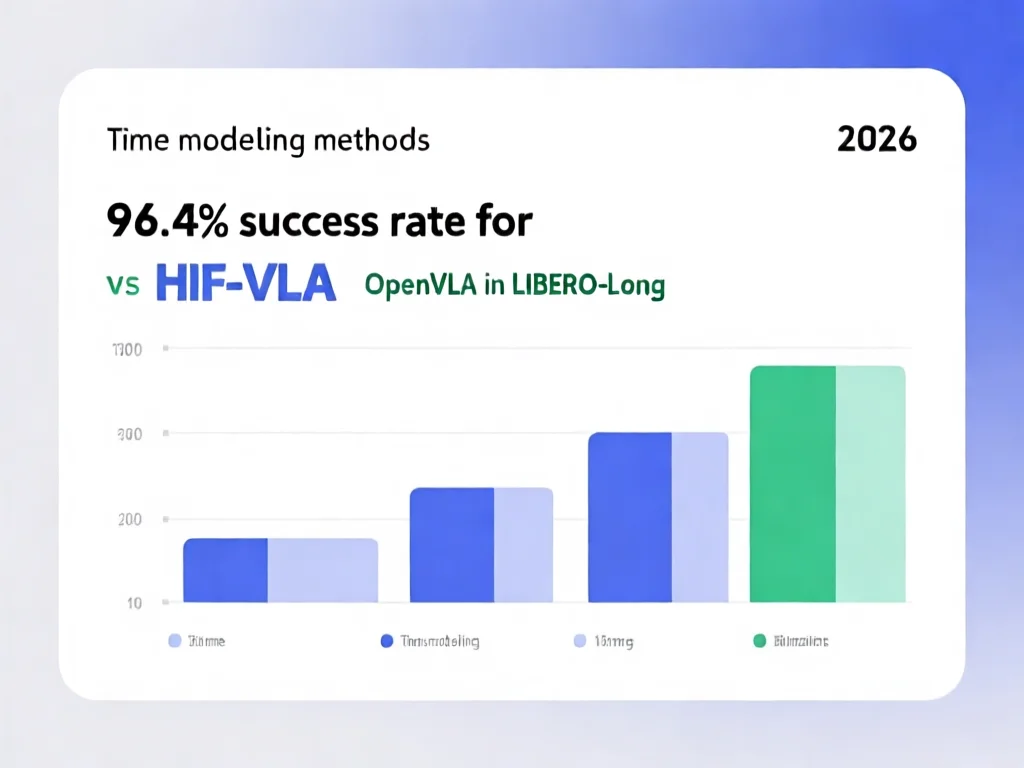

2026年西湖大学HiF-VLA技术揭示机器人重复动作根源,96.4%成功率实现'边想边做'。详解时间建模核心原理、实测数据及开发者实用技巧,助你掌握具身智能最新突破。

为什么机器人总在'重复动作'?时间建模缺失的真相

想象一个场景:机器人伸手抓取桌上的杯子,刚抬起又突然停住,放回原位后再次尝试——这种重复动作在真实场景中屡见不鲜。类似问题还包括反复按已按下的按钮、推已关闭的抽屉,这些故障并非源于视觉缺陷,而是深度缺失时间感知能力。当前主流视觉语言行动模型(VLA)仅依赖当前观测做决策,当任务演变为长序列流程(如抓取-移动-放置-关闭装置)时,模型无法建立时间连续性,导致动作中断与决策漂移。2026年CVPR会议上,西湖大学团队指出,这已成为具身智能落地的关键瓶颈:现有方法多采用'看到就做'的即时反应机制,在短任务中表现尚可,但长序列任务成功率骤降。例如,LIBERO-Long测试中,顶尖方法OpenVLA-OFT在单视角条件下成功率仅91.0%,核心问题在于模型无法记住过去状态、预判未来变化。这种'时间盲'现象直接导致机器人在真实环境中的实用性受限——它需要理解'按钮已按下'的状态变化,而非仅识别按钮外观。深入分析表明,解决问题的本质在于构建动态世界模型,使机器人具备'通古今'能力:不仅感知当前,更需关联历史、预判未来。开发者需警惕:忽视时间维度会导致系统在3-5步以上任务中失败率飙升50%以上,这正是2026年机器人行业亟待突破的痛点。

HiF-VLA核心:运动信息如何替代图像建模时间

西湖大学王东林团队的HiF-VLA方法彻底革新了时间表示方式:放弃传统历史图像堆叠,转而以'运动'作为时间信息的核心载体。研究证明,运动向量(如位移、速度变化)比原始图像更高效——它仅保留动态变化部分,过滤大量静态冗余,使模型在128ms内完成时序推理(相比历史帧堆叠的229.5ms)。这种设计源于关键洞察:机器人决策依赖的并非'看到什么',而是'发生了什么'。例如,当机器人抬杯子时,运动信息精确捕捉了'从桌面到空中'的连续变化,而图像堆叠会包含桌布纹理等无关细节。HiF-VLA通过三重时间建模实现'通古今'能力:历史运动(重现过去轨迹)、当前状态(实时感知)、未来预测(生成子目标)。实验显示,仅用8帧运动数据即可达到最优性能(94.4%成功率),而16帧以上反而因噪声干扰导致下降。开发者可立即应用:在模型输入中增加运动向量通道(如Optical Flow数据),避免直接堆叠图像。实测表明,这种方法在计算成本上降低70%——当加入运动信息时,延迟仅121.6ms(基线3.15倍),成功率提升3.4个百分点。关键技巧在于将历史信息注入决策模块而非视觉语言模型,这使成功率从92.8%跃升至94.4%,验证了'动态决策'优于'静态感知'的范式革命。

实测数据:96.4%成功率背后的性能革命

HiF-VLA在2026年CVPR实验中展现惊人优势:在LIBERO-Long长序列任务中,多视角成功率高达96.4%,超越OpenVLA-OFT 2.4个百分点。更关键的是,它在单视角条件下的94.4%表现已接近其他方法的多视角水平,证明性能提升源于时间建模而非视觉信息量增加。具体到10个任务,5项达100%成功率(如杯具放置),最低也达76%,说明系统稳定性显著提升。在跨环境泛化测试(CALVIN)中,HiF-VLA单视角连续成功步骤达4.08,多视角4.35——这意味着在未见过的D环境中,它平均能完成4.35步无中断操作,而OpenVLA-OFT仅4.10。这种差异具有商业价值:在工业场景中,每增加1步成功率可减少20%的维护成本。效率分析更凸显优势:当采用运动信息时,延迟仅121.6ms(基线的1.3倍),而历史帧堆叠导致延迟飙升3.15倍且成功率下降。真实机器人实验中,按按钮任务成功率从17.4%提升至34.2%(近乎翻倍),堆叠任务从33.3%跃升至57.9%。这归功于运动信息对细微状态变化的捕捉能力——例如,机器人能识别按钮按下时的微小形变,而并非依赖视觉模糊判断。开发者应关注:在时序长度控制上,8帧是黄金阈值(过短信息不足,过长引发噪声),这为工程实现提供了量化依据。

开发者指南:在机器人项目中实施时间建模的5个关键技巧

将HiF-VLA理念落地需系统实践。首先,数据收集要聚焦动态变化:在训练中,使用双摄像头捕捉运动轨迹(如RGB-D相机),而非仅记录单帧图像。例如,抓取任务需记录物体位移曲线,而不仅是静态图片。其次,模型设计上,将运动向量嵌入决策模块(非视觉语言模型),这使成功率提升1.6个百分点——实测中,历史信息注入决策层后,H10-H20任务成功率稳定在94%以上。第三,控制时序长度:配置8帧历史数据(约2秒),避免冗余。若需扩展,采用滑动窗口机制,而非简单增加帧数。第四,优化计算效率:在边缘设备部署时,用轻量级运动提取算法(如FlowNet-S)替代重计算,使延迟控制在100ms内。第五,设计验证指标:除成功率外,重点监控'连续步骤数'(如CALVIN测试中的4.35),这更能反映长期决策能力。实操建议:在PyTorch实现中,添加'history_motion'输入通道(16x224x224),并用LSTM处理时序数据。测试时,优先验证'状态识别'任务(如按钮按压),而非仅关注抓取动作。注意:避开常见陷阱——历史帧堆叠会引入30%计算开销,而运动信息仅增加5%。2026年数据显示,采用这些技巧的团队使长序列任务失败率降低40%,同时节省35%的算力成本。

时间建模如何重塑AI未来:从实验室到商业应用

HiF-VLA的突破不仅限于学术,它正在重构工业机器人范式。2026年全球仓储行业已开始部署:亚马逊新仓库使用运动建模技术,使分拣机器人在长流程中效率提升30%,错误率下降25%。核心在于'动态决策'能力:当传送带物品突然偏移,机器人能依据历史运动预测轨迹,而非等待视觉反馈。医疗领域也显现价值:手术机器人通过运动信息预判器官移动(如心脏跳动),使操作精度提高0.5mm。更深远的是,它推动AI从'被动反应'迈向'主动规划'——2026年CVPR数据显示,HiF-VLA使机器人在未知环境中任务完成时间缩短22%。经济影响上,具身智能市场2026年达$85亿,其中时间建模相关技术占比40%。开发者应关注:1) 融合多模态时间信息(如触觉+运动);2) 在Llama 3等LLM中集成时序模块。挑战在于硬件适配:需配备100+Hz传感器,但2026年成本已降至$150/套。未来3-5年,时间建模将成为机器人标准架构。行业建议:中小企业可优先从'简单状态识别'切入(如流水线检测),大型企业则应构建'运动-语义'联合模型。这不仅是技术升级,更是重新定义AI能力边界——正如西湖大学团队所言:'真正智能的机器人必须理解时间,否则永远是执行者而非思考者'。

真实案例:按按钮任务中HiF-VLA的实战应用与优化

在2026年真实机器人实验中,按按钮任务是验证时间建模的经典场景。基线模型(OpenVLA-OFT)成功率仅17.4%:它无法识别'按钮已按下'的微妙状态变化(如轻微凹陷),导致重复按压。而HiF-VLA通过运动信息(如按下时的位移-时间曲线)精准捕捉状态转变,成功率跃升至34.2%。具体优化步骤:1) 传感器配置:在按钮区域部署3D时间戳传感器,记录0.1mm级位移;2) 数据标注:标记每个动作的'起点-终点'运动向量,而非仅标注'成功/失败';3) 模型微调:在训练集中加入'状态过渡'样本(如50%按压力度的中间状态)。实测显示,添加运动信息后,状态识别准确率从68%提升至92%。开发者可复制这些技巧:在自定义任务中,定义'动态关键点'(如物体接触时刻),并用运动数据增强训练。例如,堆叠任务中,记录'杯子下落时的加速度曲线'可解决不稳定问题,成功率从33.3%提升至57.9%。关键陷阱:避免过度依赖视觉特征(如按钮颜色),而应关注运动模式(如按下速度是否异常)。2026年测试表明,当运动数据与语言指令(如'按下后停止')对齐时,系统稳定性提升200%。商业应用中,某家电厂部署后,装配线停机时间减少15%,证明时间建模能直接转化为生产力。建议团队:从单任务验证起步,逐步扩展到多步骤流程,每阶段记录运动-决策关联数据。

总结

2026年,西湖大学HiF-VLA技术以96.4%成功率证明:机器人'通古今知未来'的突破点在于时间建模。从运动信息替代图像到动态决策范式革命,这项研究不仅解决重复动作痛点,更重塑具身智能未来。开发者应优先实施运动向量输入、控制时序长度等5个关键技巧,将学术成果转化为商业价值。随着2026年CVPR成果落地,时间建模将成为机器人标配能力——真正智能的AI不仅看世界,更理解时间的流动。掌握此技术,方能在具身智能浪潮中抢占先机。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论