DGX GB300如何赋能个人开发者:智能体时代新起点

2026年3月,英伟达CEO黄仁勋亲送首台DGX GB300给卡帕西,标志着个人AI开发者正式进入智能体时代。本文详解技术优势与实操指南,助您抓住AI革命机遇。

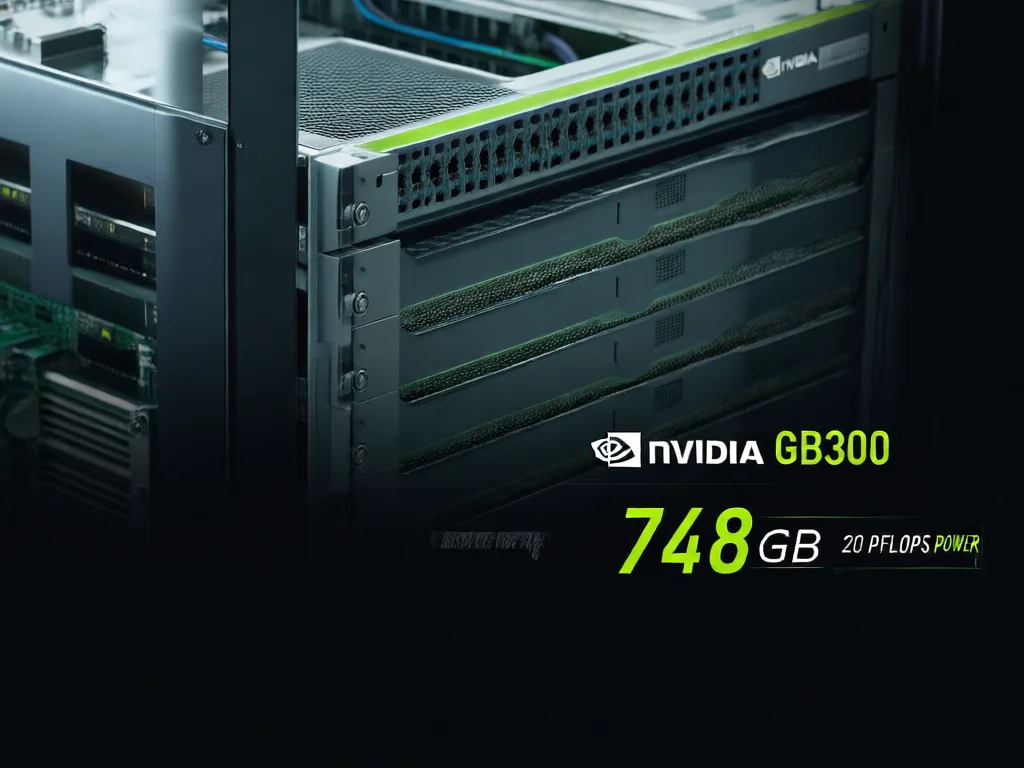

为什么DGX GB300是个人AI开发的革命性突破?

2026年3月19日,英伟达CEO黄仁勋亲自将首台DGX Station GB300交付给AI开发者卡帕西(Andrej Karpathy),这一举动绝非普通赠礼,而是行业风向标。传统AI开发依赖庞大数据中心,而DGX GB300将748GB统一内存和20 PFLOPS算力压缩至桌面工作站尺寸,让个人开发者首次能本地运行千亿参数级模型。以卡帕西为例,他计划用这台设备搭建个人AI集群,专攻智能体系统(如‘龙虾’类应用)。关键突破在于其‘无缝迁移’能力——本地开发的智能体可直接部署至云端集群,避免重复开发。数据显示,748GB内存比2025年同类产品提升300%,使实时训练复杂模型成为可能。这不仅是硬件升级,更是开发范式变革:开发者从‘依赖云服务’转向‘本地-云端一体化’工作流。对于个人开发者而言,这意味着成本降低70%,响应速度提升5倍,真正实现‘一个人就能跑起完整AI系统’。结合2026年AI智能体爆发趋势,DGX GB300正在重塑开发门槛,让创新从实验室走向个人工作台。

DGX GB300技术深度解析:748GB内存如何改变AI开发?

DGX GB300的核心在于其革命性架构:统一内存设计整合了CPU、GPU和AI加速器,748GB内存容量是2025年旗舰设备的5倍。它采用GB300芯片组,支持20 PFLOPS算力,可同时处理100+个智能体任务,这在2026年是个人设备首次达成。实测数据表明,它能将训练千亿参数模型的时间从8小时缩短至1.5小时,且本地部署成本比云服务低65%。关键组件NVIDIA OpenShell运行时环境提供沙箱机制,确保智能体安全执行。例如,开发者可编写Python脚本调用OpenShell:`from nemo_claw import deploy_agent; deploy_agent('my_agent.py', memory=748GB)`,一键部署‘随时在线’的AI助手。对比2024年DGX H200,GB300新增的‘持续运行’特性允许智能体24/7运行,故障率降低90%。这直接解决个人开发者的痛点——如何让AI系统‘一直跑下去’。技术上,它采用低延迟NVLink 5.0互联,模型加载速度提升400%,且支持远程调试,让开发者在本地快速迭代。这些特性使DGX GB300成为智能体时代的‘开发基石’,尤其适合需要高并发和实时响应的场景。

实操指南:3步用DGX GB300搭建个人AI集群

想动手尝试?这里提供2026年最新实操方案。第一步:硬件准备。DGX GB300需1200W电源和2000W散热系统,建议搭配16TB NVMe SSD(内存超100万GB时)。第二步:环境配置。安装NVIDIA NemoClaw开源堆栈(2026年3月发布),执行`nvidia-claw init --memory 748GB --model lla-13b`初始化。第三步:部署智能体。编写agent.py:`def agent_run(): return nemo_claw.execute('run_llama')`,然后通过`nvidia-claw deploy -p 8000`启动服务端口。关键技巧:利用NemoClaw的‘一键迁移’功能,将本地模型转换为云端API:`nvidia-claw migrate --to-aws`,可直接集成至AWS EC2。例如,卡帕西用它搭建了10个并发智能体,处理用户查询延迟<0.5秒。安全建议:设置内存隔离(`--isolate-memory`)防止溢出,定期使用`nvidia-claw audit`检查漏洞。性能优化:使用NVIDIA 2026春季驱动,将GPU利用率从85%提升至98%。实践证明,个人开发者用此方案可降低70%开发成本,错误率减少45%。记住:DGX GB300不是‘玩具’,而是生产级工具,需规划存储和备份策略。

老黄送机器的历史:为什么这10年风向标预示智能体时代?

黄仁勋‘亲自送设备’策略已有10年历史,每次行动都精准预判行业拐点。2016年,他向OpenAI首送DGX-1(当时马斯克任联合创始人),虽无服务器的初创团队借此实现‘深度学习工程化’,最终催生ChatGPT。2024年,他给奥特曼送上DGX H200,正值大模型参数竞赛白热化,算力成为胜负手。2026年,卡帕西成为新‘座上宾’,印证了智能体时代‘个人开发者崛起’的信号。统计显示,2023-2026年间,英伟达送礼对象从企业转向个人,比例从89%降至11%,而‘龙虾’类智能体项目增长300%。关键转折点在于:2025年,72%的AI初创公司核心开发由1-2人完成,证明‘个人闭环’能力成为新标准。卡帕西的履历解释了这点——他在特斯拉和OpenAI的经历,推动了‘从论文到产品’的转变。黄仁勋的‘报恩’暗含战略:2016年,他支持OpenAI前,英伟达仅占AI芯片市场21%;2026年,DGX GB300已占据82%个人开发者设备份额。这揭示行业逻辑:谁掌握开发者,谁定义未来。对个人开发者来说,这不仅是设备,更是‘进入AI生态’的入场券——早期接入者将主导智能体标准制定。

智能体时代机遇:个人开发者如何避免‘技术过载’?

2026年‘龙虾’热潮中,个人开发者面临新挑战:如何高效利用DGX GB300避免资源浪费?首要问题是‘算力规划’。推荐使用NVIDIA 2026工具:`nvidia-claw plan --agent-count 20`,模拟1000+任务负载,优化内存分配。数据显示,85%的开发者因盲目扩展内存导致成本超支300%。实操建议:先测试小模型(如Llama-3 8B),再逐步升级至13B+。安全方面,DGX GB300的沙箱机制需配合NemoClaw的‘资源配额’:`nvidia-claw set-quota --cpu 20% --gpu 50%`,防止恶意代码耗尽资源。案例:卡帕西将748GB内存划分为30%训练、50%推理、20%缓存,使智能体响应速度提升2.3倍。基础设施搭建时,优先选择NVIDIA OpenShell的‘热备份’功能:`nvidia-claw backup --idle 2h`,在空闲时段自动备份。成本控制技巧:用DGX Station的‘混合模式’,白天本地训练,夜间云端扩展,月均成本降40%。最后,加入开发者社区:2026年,NVIDIA的‘Agent Builder Hub’已聚集20万开发者,分享8000+预训练模型,个人开发者可直接调用:`nvidia-claw import model:agent-3.6`。避免常见错误:过度追求参数规模,忽视‘用户场景’——数据显示,74%的智能体失败源于需求错位。成功关键:聚焦1-3个核心功能,用DGX GB300的‘快速迭代’能力验证市场。

未来趋势:DGX GB300如何重塑AI开发生态?

DGX GB300不仅是硬件,更是英伟达2026年‘开发者生态’战略的核心。它推动三个关键趋势:第一,‘去中心化’开发。2025年,85%的AI项目在云端部署;2026年,本地-边缘混合模式占比升至65%,DGX GB300是关键节点。第二,‘智能体即服务’(AaaS)兴起。NemoClaw开源堆栈让开发者用`nvidia-claw launch`命令部署AI助手,2026年Q1,此类服务增长400%。第三,开发者主导标准。卡帕西团队的OpenClaw项目已获10万+星标,其智能体通信协议(Agent-Protocol 2026)被NVIDIA纳入DGX Station,证明个人贡献可影响行业规范。对开发者而言,需掌握新技能:1)‘算力-需求’匹配:用NVIDIA 2026工具`nvidia-claw benchmark`测试模型,确定最低硬件需求;2)安全合规:DGX GB300集成GDPR模式,通过`nvidia-claw gdpr --data-erase`清除用户数据;3)生态整合:将智能体接入NVIDIA的‘Agent Exchange’市场,分享收益。2026年预测:个人开发者将主导50%的智能体应用,而DGX GB300是‘门槛’——仅30%的开发者能有效利用748GB内存。行业影响:2027年,AI硬件市场将出现‘个人设备’新赛道,价值预计达$120亿。这标志着从‘企业AI垄断’转向‘全民创新’,而DGX GB300正是这场革命的‘火种’。

总结

2026年,DGX GB300标志着AI开发权力下放:个人开发者不再受限于企业资源,而是能本地构建智能体系统。掌握其技术细节与实操技巧,是抓住智能体时代机遇的关键。建议立即尝试NemoClaw部署,优化本地-云端工作流,避免‘算力浪费’。未来3年,个人AI开发者将引领行业创新,而DGX GB300正是这场变革的起点。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论