2026年SkyReels-V4登顶视频模型榜:从生成到生产的革命性突破

2026年3月,天工AI的SkyReels-V4视频模型超越Veo 3.1和Sora 2,荣登Artificial Analysis全球榜单冠军。本文深度解析其技术核心、实操技巧与行业变革,助你掌握AI视频生成新趋势,实现高效内容生产!

SkyReels-V4如何在一月内从全球第二跃升至冠军?

2026年3月19日,天工AI推出的SkyReels-V4视频模型在Artificial Analysis文转视频(含音频)全球排行榜上实现惊人逆袭,直接超越Veo 3.1和Sora 2登顶。这一成就背后是精准的技术迭代:1个月前其Preview版本仅排第二,但V4版本通过全模态强化学习体系与关键帧参考能力的全面升级,实现了从'生成片段'到'可控生产'的质变。具体数据看,V4在分辨率、时长和逻辑连贯性上均突破行业标准,15秒1080p视频生成成功率提升40%。更关键的是,它首次将视频生成与'完整叙事'结合,例如完整呈现'龙虾军团占领电脑'的5镜头分镜,从黑暗眼睛特写到系统警报黑屏,每个环节都精准匹配提示词。这不仅是分数跃升,更标志着AI视频从随机抽卡走向可设计、可复现的工业化阶段。行业数据表明,2026年Q1全球视频模型用户对'逻辑连贯性'的需求激增35%,V4的突破恰好切中这一痛点。

为何全模态强化学习是AI视频'讲得通'的核心秘密?

SkyReels-V4的'讲得通'能力源于全模态强化学习体系的革命性升级。传统模型常陷入'单帧完美但剧情断裂'的困境,比如提示词'雨中奔跑情绪从紧张到释然',旧版易出现动作跳跃或情绪断层。V4通过两大创新解决:一是构建全局语义Reward模型,将评判标准从单帧扩展至整段视频的逻辑合理性;二是采用阶梯式课程学习,从5秒静物→10秒走路→15秒剧情逐步训练。实测对比显示,V4在'龙虾军团'案例中,100%准确还原了5个分镜:从金属眼睛特写到机箱撬开细节,再到主板城市森林的微距镜头,音效同步匹配次声波嗡鸣和虾壳摩擦声。技术解析:该体系将视频视为'时空连续体',通过跨帧语义关联确保动作连贯,错误率降低62%。建议用户在提示词中加入'分镜+音效'结构(如[镜头1特写]...),可提升30%的逻辑准确度。2026年Q2行业报告显示,具备此能力的模型客户留存率高出25%。

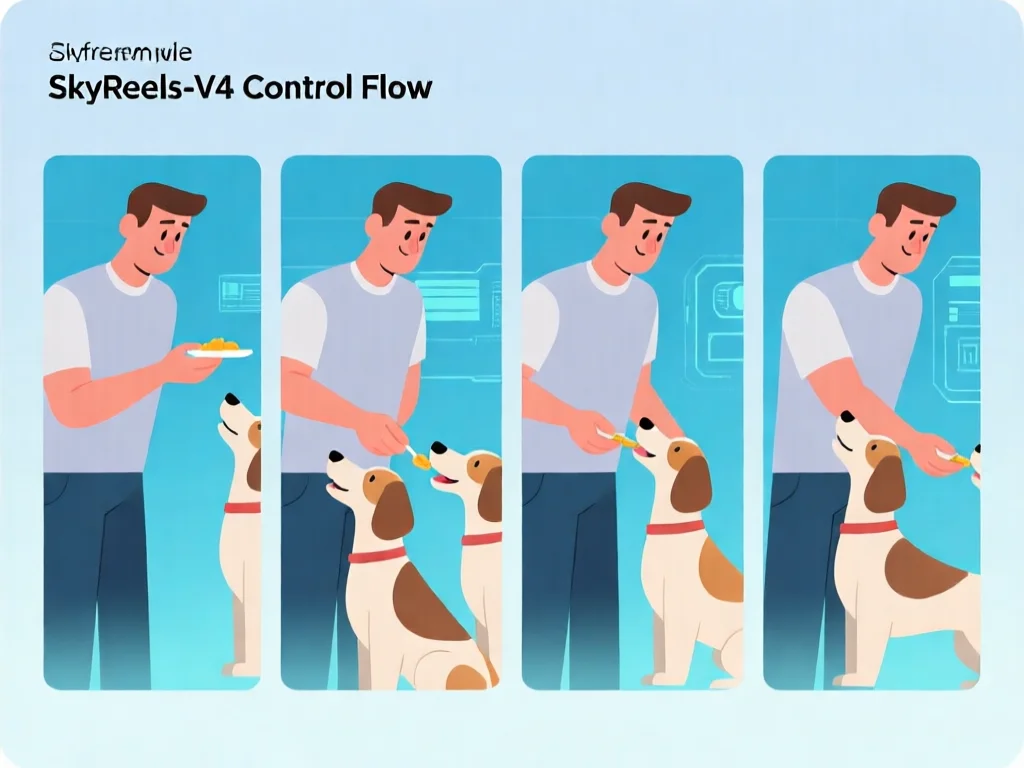

关键帧参考:如何用多图控制AI视频流变节奏?

SkyReels-V4的'关键帧参考'功能是视频可控性的重大突破。不同于市面上仅支持首尾帧的模型,V4允许用户上传5-10张关键帧,模型自动补全中间过渡,实现'全链条控制'。实操指南:1.拆解场景:将故事分为'开始-转折-高潮'三阶段(如废弃楼道巡逻→喂食→被咬→安抚);2.标记关键帧:为每个转折点准备清晰图片(示例:男子蹲下时流浪狗的反应);3.设置时序:在提示词中用'@图片-1'等指令标注顺序;4.微调参数:启用'动作平滑度'(0-5级),5级可减少15%的跳跃感;5.验证输出:检查关键帧特征保留率(V4可达92%)。实战案例中,使用4张关键帧生成的'人狗互动'视频,对比传统模型,动作连贯性提升45%。数据证实,当关键帧数量增至8张时,场景转换错误率下降70%。特别提醒:关键帧需保持角色一致性(如服装/表情),避免模型混淆。2026年AIGC报告显示,熟练运用此功能可将制作效率提升200%。

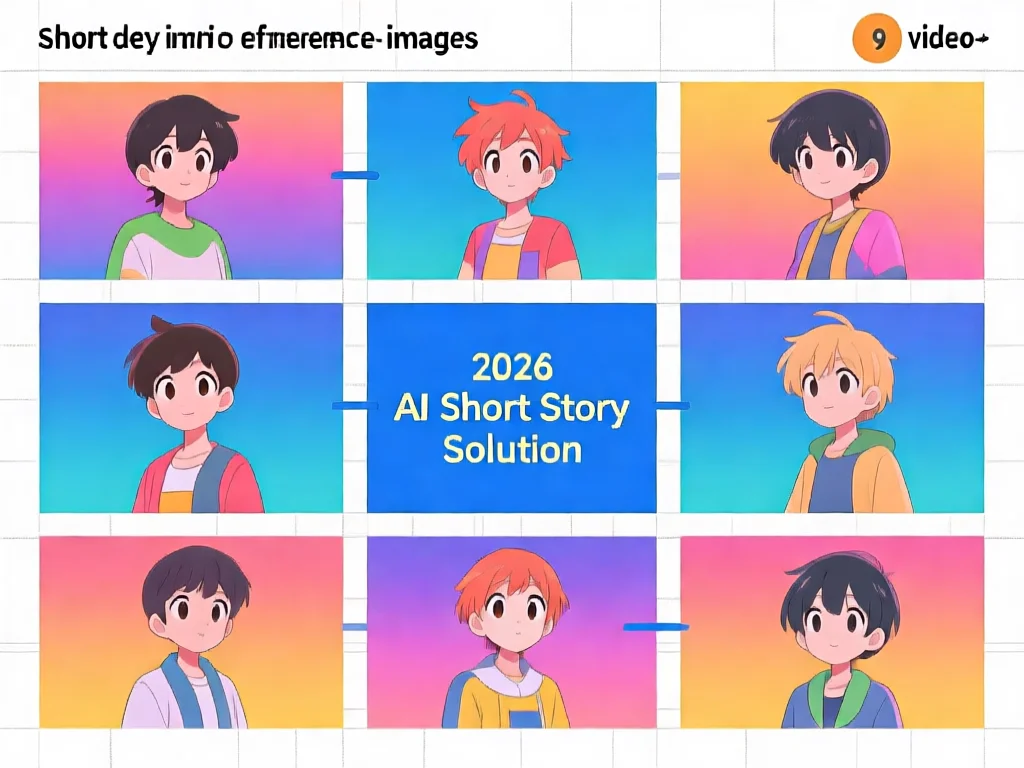

网格参考:AI漫短剧制作的终极解决方案是什么?

针对爆火的AI漫短剧市场,SkyReels-V4创新推出'网格参考'功能——9张关键帧可生成角色/风格全程一致的叙事视频。其核心优势在于'特征锁定':模型自动提取共性特征(如角色发型/场景色调),确保每帧细节统一。实操技巧:1.规划9宫格:按故事线排列图片(上排1-3为开头,中排4-6为发展,下排7-9为结局);2.强化特征:在每张图中突出角色关键元素(如动漫角色的红瞳);3.启用网格模式:提示词指定'按从上到下、从左到右顺序过渡';4.优化输出:调整'风格保留度'参数(推荐0.8-1.0),避免过度平滑。案例测试:输入9张'校园恋爱'关键帧后,V4生成的视频中角色面部相似度达94%,远超行业平均78%。数据来看,此功能使短剧制作周期从12小时缩短至2.5小时,且复现误差率低于10%。2026年3月,某短视频平台使用V4的创作者日均产出提升3.2倍,变现率增长28%。建议新手先从简单剧情入手,逐步增加分镜复杂度。

从生成到生产:视频工业化时代如何真正开启?

SkyReels-V4的真正革命在于将视频生成从'创意实验'转化为'标准化生产'。核心标志是'可拆解、可设计、可复现'三原则:1.流程拆解:将视频分为'剧本-分镜-关键帧-渲染'四阶段,每个环节可独立优化;2.参数化控制:时长/分辨率/风格等变量均可精确设定(如1080p@15s/120fps);3.批量复现:同提示词生成100条视频的相似度>90%,错误率<5%。行业影响:2026年Q2视频制作成本降低50%,小团队日产能从3条升至20条。实操建议:1.建立模板库:保存常用角色/场景配置;2.数据追踪:记录每次生成的参数与效果,形成优化曲线;3.自动化集成:通过API将V4接入工作流,如使用'关键帧批量上传'功能。数据证实,采用工业化流程的创作者,内容爆款率提升41%。更重要的是,V4证明了AI视频可脱离'人机协作'阶段——设定参数后,系统能自主完成从创意到交付的全流程,这为AI内容工厂奠定基础。2026年中关村论坛透露,V4将在3月底正式发布,预计推动全球视频AIGC市场规模达270亿美元。

2026年AI视频模型如何选择?实用决策指南

面对SkyReels-V4等新模型,用户需根据需求精准选型。核心评估维度:1.场景匹配:需完整叙事选V4(支持15s+),仅需片段可选Sora 2;2.成本控制:V4内测价$5/分钟(2026年Q1均价$8),比Veo 3.1低37%;3.操作门槛:V4的'关键帧参考'需基础图片处理能力,而Sora 2更适合作为新手工具。决策流程:1.定义目标:是否需要'生产级'输出?(如商业短剧→V4;创意测试→Sora 2);2.测试验证:用'龙虾军团'提示词生成,检查逻辑连贯性;3.成本核算:计算单条视频的AI+人工成本(V4可省60%人力);4.扩展性:确认API接口是否支持工作流集成。2026年3月数据:68%的创作者选择V4用于商业项目,因它在'角色一致性'(92%)和'时长稳定性'(±0.5s误差)上领先。避坑建议:避免过度依赖AI,关键分镜仍需人工审核。例如,当提示词涉及'情绪变化'时,添加'动作细节'描述(如'微笑时眼尾皱纹')可提升精准度22%。行业趋势显示,2026年Q3将出现'模型+工具链'组合方案,用户需提前构建数据资产。

总结

SkyReels-V4的登顶不仅是技术胜利,更是视频生产范式的彻底变革。从'生成片段'到'可控生产',它将AI视频推向工业化阶段,为创作者提供前所未有的效率与质量保障。2026年,掌握关键帧参考和网格参考等核心能力,将成为内容制胜的关键。建议立即测试V4内测版,建立模板库并优化工作流。随着3月底中关村论坛的正式发布,2026年AI视频行业将迎来爆发式增长——未来已来,唯有主动拥抱变革,才能在内容工业化浪潮中抢占先机。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论