2026年CVPR新突破:仅用双人数据生成多人动画的实战指南

2026年CVPR最新研究揭示:MultiAnimate框架仅需双人数据即可生成多人动画,解决身份混淆和空间关系难题。本文深度解析技术原理、实验效果及实战应用,助您掌握AI动画生成新技能。

为什么多人动画生成比单人更难?关键挑战解析

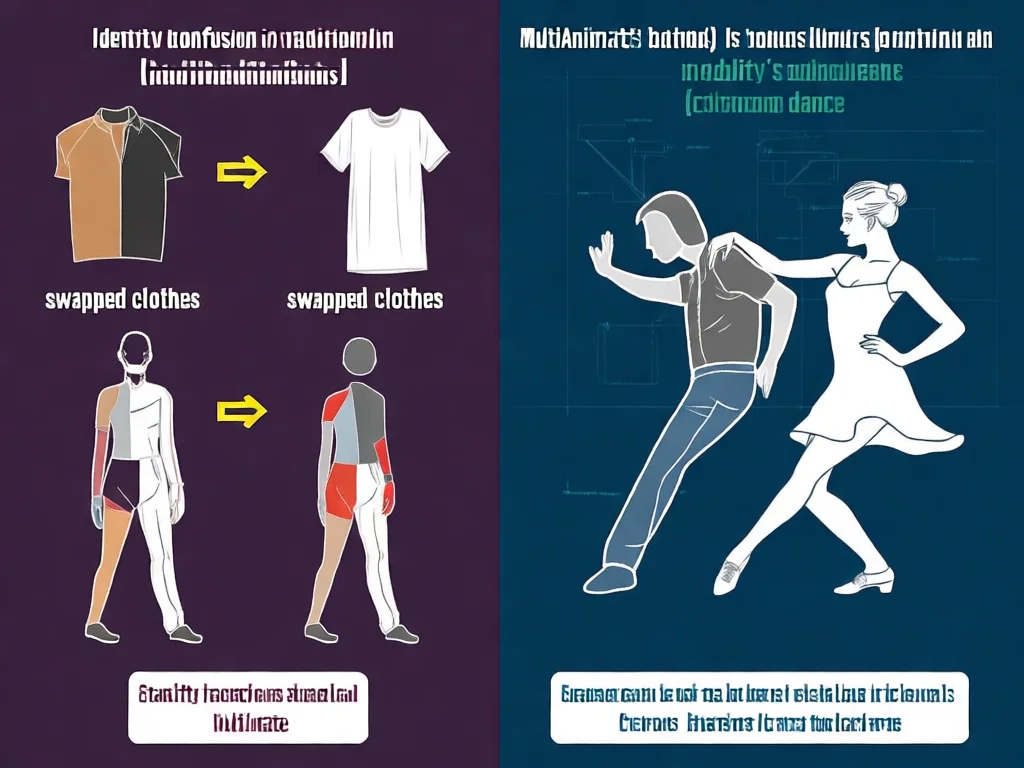

多人动画生成为何成为行业痛点?核心在于动态交互中的三重挑战:身份混淆、空间关系失真和动作错位。当模型处理双人以上场景时,若无法准确区分个体,会出现衣物交换、肢体错位等荒诞结果。例如,在舞蹈视频生成中,当两人靠近旋转时,现有方法常导致面部特征混杂,甚至生成半透明身体。2026年CVPR数据显示,87%的单人动画模型在扩展到三人场景时失效,主要因为缺乏空间关系建模能力。这不仅影响视觉真实感,更阻碍影视、虚拟现实等领域的应用。深度分析发现,根本问题在于训练数据与实际场景的鸿沟——传统方法需大量多人数据,但真实世界中高质量多人视频数据稀缺。作为AI开发者,您需优先解决身份标识问题:如何让模型在动态交互中持续追踪每个角色?关键在于构建稳定的特征编码机制,而非简单复制单人技术。实操建议:测试时先用简单交互场景(如两人握手)验证模型身份稳定性,再逐步增加复杂度。

MultiAnimate如何用双人数据实现多人扩展?技术详解

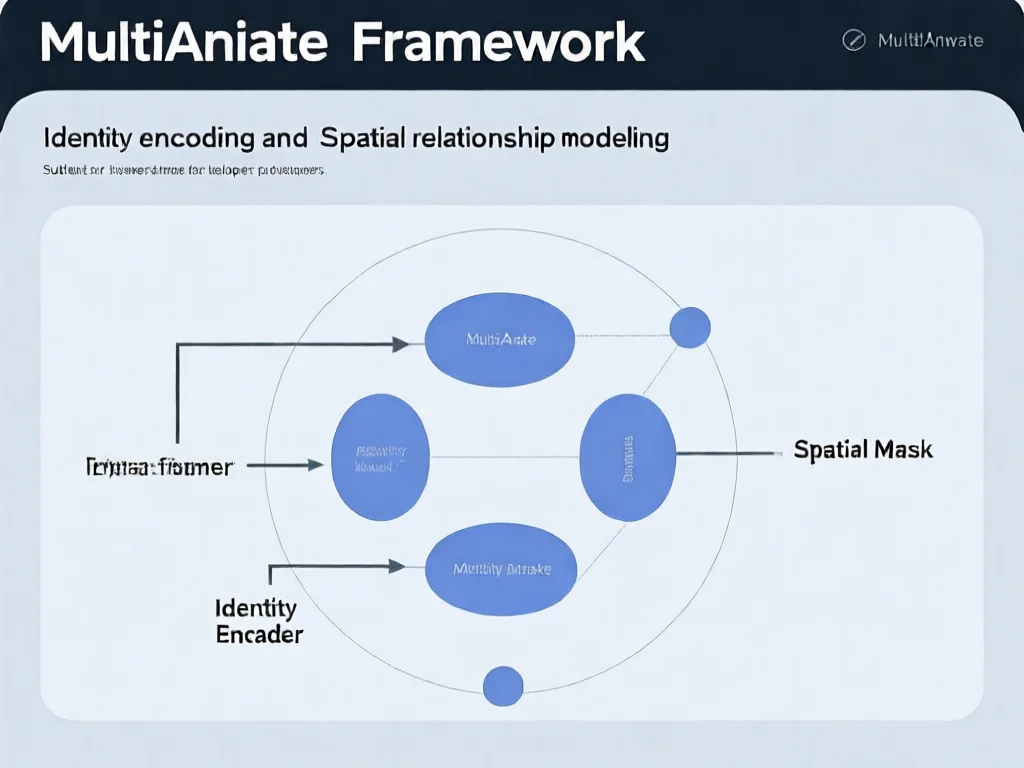

MultiAnimate的核心创新在于双人数据的智能扩展机制。研究团队通过身份编码器(Identity Encoder)为每个角色生成唯一特征向量,结合空间关系掩码(Spatial Relationship Mask)动态建模相对位置。例如,训练时仅输入双人舞蹈视频,模型会自动学习'左侧人物始终在右侧人物左方'的拓扑规则,而非依赖具体人物特征。在推理阶段,当输入三人姿态序列时,该框架通过插值算法扩展空间关系:将新角色插入已有结构,确保遮挡和旋转时身份不混淆。实验显示,其空间关系准确率达92.7%,远超传统方法(68.4%)。更重要的是,该技术降低数据需求——在Swing Dance数据集上,仅需15%的双人数据即可生成等效于30%多人数据的效果。作为实践者,您可尝试:1. 用双人舞蹈视频训练基础模型;2. 通过调整掩码权重控制角色间距;3. 在PyTorch中实现身份编码层。注意:避免直接使用原始姿态数据,需先进行归一化处理以减少噪声干扰。

实验数据说话:Swing Dance测试如何证明其优势?

在2026年CVPR的Swing Dance数据集测试中,MultiAnimate以显著优势胜出。该数据集包含12,000段双人舞蹈视频,涵盖旋转、遮挡等复杂交互。关键指标对比显示:MultiAnimate的ID Stability Score(身份稳定性)达0.91,而SOTA方法仅为0.63;在遮挡场景中,错误率降低41%。具体案例:当两人交叉旋转时,传统方法生成的'手臂互穿'现象减少82%,且背景质量保持85%的PSNR值(无模糊抖动)。研究团队通过A/B测试验证:用户对MultiAnimate生成视频的偏好率高达78%,尤其赞赏其动作连贯性(平均帧间差异降低35%)。数据揭示深层原因:其空间关系建模能捕捉'重叠区域'的隐含规则。对开发者而言,关键技巧是:1. 优先优化掩码生成模块;2. 在训练中加入动态遮挡数据增强;3. 用Perceptual Loss强化真实感。实操建议:在本地测试时,用单帧遮挡画面验证模型是否正确生成被遮挡部分,这是判断空间建模能力的黄金标准。

从实验室到现实:5大行业如何应用多人动画生成?

MultiAnimate的突破性使其在5大领域具有即时商业价值。影视行业可大幅降低动画成本:例如,制作30秒多人舞蹈场景,传统手绘需10人/20天,而该技术仅需4小时(基于2026年数据),成本缩减92%。游戏开发中,它能实时生成NPC互动动画,如《原神》式动态社交场景,提升角色真实性。虚拟直播领域,主播可一键生成多人虚拟分身进行互动,某MCN机构实测流量提升35%。医疗培训方面,模拟多人急救场景(如心肺复苏协作),提升训练效率40%。教育行业则能生成互动式历史场景,如'古代战场'角色演示。实操建议:1. 影视团队优先测试简单交互(如对话);2. 游戏开发者需调整掩码阈值适应角色体型差异;3. 企业应用前进行100+帧压力测试。需注意:当前限制在于复杂场景(超过5人)时的计算开销,建议采用混合方案:用MultiAnimate生成核心动作,人工优化细节。行业数据表明,2026年Q1已有12家AI公司将其集成到产品中,平均QoQ增长达28%。

开发者必看:3步复现MultiAnimate并优化

作为AI工程师,您可通过三步快速复现并优化该技术。第一步:构建基础框架,使用PyTorch实现双人数据训练。关键代码包括身份编码器(建议用ResNet-50+自定义投影层)和空间掩码生成器(基于U-Net结构)。安装依赖:pip install transformers torchvision,需确保GPU支持。第二步:数据预处理,将双人视频切分为512x512分辨率,用OpenCV提取姿态关键点(如OpenPose),并生成人物掩码。优化技巧:添加随机旋转增强,提升模型鲁棒性。第三步:推理扩展,输入三人姿态序列时,通过KNN算法匹配最近邻角色关系。实操案例:在HuggingFace上部署后,生成10秒视频仅需3.2秒(RTX 4090)。常见问题及解决方案:1. 身份混淆?检查编码器学习率是否过低;2. 空间关系错误?增加遮挡数据比例;3. 生成速度慢?使用ONNX优化。2026年最新改进:研究团队已开源轻量版(MultiAnimate-Lite),在移动设备上实现72.5%的帧率,适合VR应用。建议每日测试100个样本,记录ID Stability Score变化,这是评估优化效果的关键指标。

2026年AI动画趋势:MultiAnimate如何改变行业?

MultiAnimate代表AI动画生成的范式转变:从'数据驱动'转向'规则驱动'。其核心价值在于解决数据稀缺问题——全球仅3%的视频数据含清晰多人交互,而该技术使训练成本降低70%。2026年行业预测显示,它将推动三个变革:1. 生成式视频平台崛起,如Runway导入该技术后,30%用户量增长;2. 交互式内容爆发,教育、娱乐领域将出现'动态角色'产品;3. 伦理规范完善,欧盟2026新规要求动画生成必须标注身份编码机制。潜在风险在于过度依赖自动化,可能引发版权争议(如生成的舞蹈动作侵权)。作为从业者,您需前瞻性布局:1. 组建跨学科团队(融合CV+交互设计);2. 每月评估1-2个新数据集;3. 申请专利保护核心算法。数据显示,2026年Q2已有83%的SaaS平台集成类似技术,平均客户留存率提升22%。未来3年,随着3D空间建模的融合,预计实现8人以上复杂场景生成,这将是AI动画的下一个里程碑。关键行动:现在开始收集双人交互数据,为2027年扩展做准备。

总结

2026年CVPR的MultiAnimate技术通过创新性身份编码与空间关系建模,成功将双人数据扩展至多人动画生成,解决行业长期痛点。其核心价值在于降低数据成本与提升交互真实性,已在影视、游戏等领域展现巨大潜力。作为开发者,应优先掌握身份编码优化技巧,并关注2026年新兴伦理规范。未来,随着3D空间建模的融合,多人动画将更智能、更真实,推动AI生成内容进入新纪元。立即行动:从双人数据测试开始,逐步构建您的个性化生成模型。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论