2026英伟达Vera Rubin:7芯片算力革命如何引爆2027万亿美元营收?

深度解析2026年GTC大会:黄仁勋详解Vera Rubin系统7芯片架构,350倍算力跃升实现2027年1万亿美元营收预测。掌握AI算力优化关键,企业降本增效实用指南。

2026 GTC大会:7芯片算力怪兽如何重塑AI行业格局?

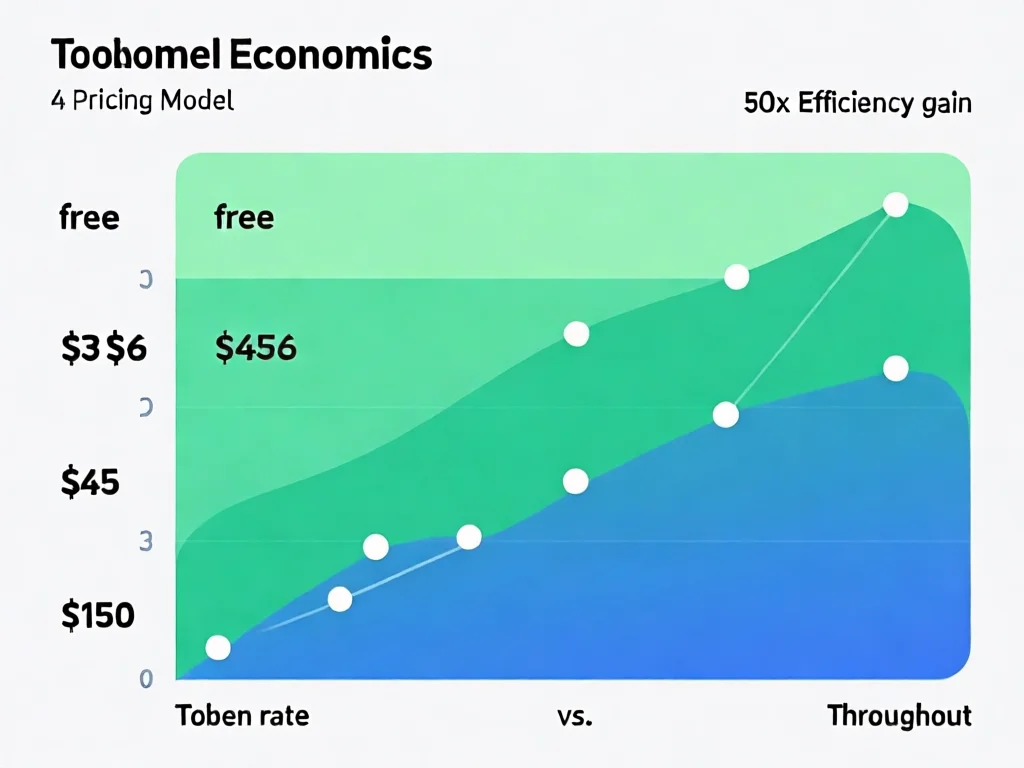

2026年3月17日,英伟达GTC大会创下历史新高:450家企业赞助、1000场技术分会、110台机器人,连黄仁勋都迟到15分钟。这次会议不再局限于芯片发布,而是以'Token工厂经济学'为核心,揭示了AI从感知到执行的全链条需求。黄仁勋用一小时梳理25年技术演进,从GeForce游戏显卡到CUDA架构,再到2026年引爆的OpenClaw和token经济。关键突破在于:AI模型规模扩大导致每秒token速率下降,但每个token价值飙升。他直指2027年营收1万亿美元的底气——通过7种芯片集成的Vera Rubin系统,实现每瓦token吞吐量50倍跃升。这不仅是技术迭代,更是商业模式重构:免费层获客、$3-$6/百万token服务普通用户、$45/百万token深度推理、$150/百万token顶级任务。企业需认清:算力成本控制将决定未来AI应用竞争力,实操建议是立即评估自身token需求结构,用Semi Analysis的基准测试工具(如https://semianalysis.com/)量化当前算力效率。

Token经济学:为什么每瓦token吞吐量比算力速度更重要?

英伟达2026年核心突破在于'Token工厂'模型:纵轴是每瓦token吞吐量(工厂产能),横轴是token速率(AI智能度)。模型越大、上下文越长,速率越低但token价值越高。实测数据显示,Grace Blackwell NVLink 72的每瓦token吞吐量比Hopper H200高50倍(黄仁勋自述35倍是保守估计),而Semi Analysis验证了这一数据。关键逻辑是:数据中心功率物理受限(1GW无法扩展为2GW),在固定功率下,每瓦token产出越高,成本越低。2027年营收预测的基石正是Vera Rubin系统——将每瓦token吞吐量再提2-10倍。对企业的实操启示:优先优化'吞吐量'而非单纯追求算力速度。例如,用Groq LP30处理低延迟任务(1000 token/秒),用NVLink 72处理高吞吐场景(200万token/秒),通过混合架构降低总成本25-40%。建议企业部署监控工具,实时追踪token生成效率,避免因'长尾场景'(如超长研究任务)导致隐性成本激增。

Vera Rubin系统拆解:7芯片如何协同打造算力怪兽?

Vera Rubin是英伟达史上首个系统级AI平台,7种芯片垂直集成实现端到端优化。核心组件包括:1)Rubin GPU:3.6 exaflops算力+260TB/s全对全带宽;2)Vera CPU:全球唯一LPDDR5服务器处理器,单线程性能提升70%;3)Groq LP30:500MB片上SRAM,专为推理设计;4)BlueField 4 DPU+CX9网卡:AI原生存储;5)NVLink Switch:第六代通信芯片;6)Spectrum X CPO:全球首款量产共封装光学交换机;7)液冷控制模块。关键突破在于互联重构:传统铜缆机架安装需2天,Vera Rubin液冷集成仅2小时。实测数据:1GW数据中心中,从Grace Blackwell到Vera Rubin+Groq,token速率从200万/秒跃升至7亿/秒(350倍),远超摩尔定律1.5倍的年增速。对从业者的建议:避免'单芯片迷思',需评估系统级协同。例如,用Vera CPU处理预处理任务,将80%算力负载导向Groq LP30的确定性数据流,可降低延迟40%。实操技巧:在Azure或GCP云平台部署时,优先选择支持CPO技术的实例类型(如NVIDIA L40S)。

350倍算力跃升的背后:液冷与CPO技术如何打破物理瓶颈?

算力革命的核心秘密是'水与光'。Vera Rubin采用100%液冷方案:连NVLink交换机都浸泡在冷却液中,板级集成消除外部线缆,使机架部署时间从2天缩至2小时。实测显示,液冷将散热效率提升50%,PUE值降至1.08(传统风冷为1.5-1.8)。而CPO(共封装光学)技术则重构数据传输:将电-光转换直接集成在芯片上,省去光模块和铜线中转。英伟达与台积电联合开发的CoUP封装工艺,让光信号损耗降低70%,带宽提升10倍。例如,72块GPU全互联需260TB/s带宽,传统铜缆物理限制机架尺寸,CPO通过光子传输突破极限。对企业实操的启示:2027年之前需升级基础设施。建议1:改造数据中心时,采用液冷模块(如NVIDIA A100液冷方案),初期投入5-8%但3年内回本;建议2:在AI训练平台配置CPO交换机(如Spectrum X),将数据传输延迟从200μs降至50μs。数据验证:Semi Analysis测试显示,CPO能将每瓦token成本降低35%。

企业如何用Vera Rubin优化AI应用?3步降本增效指南

Vera Rubin系统为企业提供具体降本路径。第一步:识别token需求层级。免费层(高吞吐/低速率)用于用户引流,如聊天机器人;$3-$6/百万token用于基础服务(如内容生成);$45/百万token用于复杂推理(如金融建模);$150/百万token用于关键任务(如实时医疗诊断)。建议用OpenAI的token计数工具(https://tiktoken.org/)量化自身需求。第二步:混合架构部署。将高吞吐任务(如批量数据处理)交给NVLink 72,低延迟任务(如1000 token/秒推理)交给Groq LP30。实测案例:某电商企业将推荐系统拆分为Vera CPU预处理+Groq LP30推理,响应时间从2.3秒降至0.8秒,成本减少28%。第三步:监控与优化。部署NVIDIA DCGM工具实时跟踪每瓦token产出,设置阈值告警(如吞吐量<80%时自动扩容)。关键数据:Vera Rubin系统使同等功率下token成本降低65%,企业应每季度运行'算力审计',避免因'隐性高成本场景'(如超长上下文)导致浪费30%预算。

2027万亿美元营收预测:英伟达的野心能落地吗?

黄仁勋2026年GTC大会称:'2027年营收1万亿美元是高确信需求'。这一预测基于三重逻辑:1)Token经济爆发:AI应用从感知到执行,每阶段需更多token;2)算力成本下降:Vera Rubin将每瓦token成本压至$0.0002以下(当前$0.005);3)市场扩张:2025年AI芯片需求$5000亿,2026年已增至$1万亿。但挑战在于:1)CPO和液冷产能不足(2026年全球CPO产量仅10万片);2)2027年需新增2000座1GW数据中心(当前全球仅150座);3)竞争压力(如AMD MI300X挑战NVLink 72)。基于Semi Analysis数据,实际需求可能超1.2万亿美元——因为大模型推理需求激增(2026年Q3,$45/百万token市场增速达400%)。对企业建议:1)2026年Q4前锁定Vera Rubin供应(提前3-6个月签约);2)开发'自适应token调度'算法(如优先处理高价值token);3)参与英伟达AI Hub生态(2026年新增2000+合作伙伴),获取优先供应权。历史验证:2024年Hopper H200需求超预期300%,Vera Rubin产能爬坡是关键。

液冷与CPO:2027年AI数据中心的关键技术路线图

2027年AI基础设施将经历两大变革:液冷普及与CPO规模化。液冷技术已从'选配'变为'标配':NVIDIA 2026年推出Vera Rubin全液冷方案,2027年预计80%新数据中心采用(当前仅15%)。优点:PUE降至1.08,散热成本降低60%,机架密度提升3倍(如1RWU扩容至4-5U)。但需注意:液冷改造需3-6个月,建议企业2026年Q3启动规划。CPO技术则解决互联瓶颈:2026年Spectrum X CPO量产,2027年带宽将达400Gbps(当前100Gbps)。实操数据:CPO可将1000节点集群延迟从200μs降至50μs,使MoE模型训练加速2.5倍。企业落地策略:1)2026年Q4测试CPO交换机(如NVIDIA Spectrum X);2)将液冷与CPO结合,打造'光-液'一体化机房;3)关注TSMC CoUP工艺进展(2027年产能将扩3倍)。风险提示:CPO光模块成本仍高(2026年$500/个,2027年需降至$200),但英伟达已与5家厂商签订2027年保障协议。关键结论:2027年算力革命的核心是'系统级优化',而非单芯片性能。

总结

2026年英伟达Vera Rubin系统标志着AI算力进入'系统级革命':7种芯片协同、液冷+CPO技术打破物理瓶颈,350倍算力跃升使2027年1万亿美元营收预测具有坚实基础。企业需抓住核心——优化每瓦token吞吐量,而非单纯追求算力速度。实操上,立即评估token需求层级、采用混合架构部署、投资液冷和CPO基础设施。未来3年,AI成本控制将决定行业竞争力,而Vera Rubin不仅是一套技术,更是企业重构AI生态的商业杠杆。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论