2026年实时交互视频生成实战:爱诗科技3亿融资与AIGC创作指南

2026年AI视频生成革命来袭!爱诗科技3亿美元C轮融资刷新行业纪录,开启实时交互新纪元。本文深度解析技术突破、实用教程与商业价值,助你抢占AIGC内容生产先机。

为什么2026年实时交互视频会颠覆内容创作生态?

2026年,AI视频生成已从单向输出转向'可玩现实'时代。爱诗科技的3亿美元C轮融资(鼎晖领投)标志着行业进入新阶段——实时交互技术让普通用户能动态控制视频走向,例如在广告中通过语音指令调整产品展示角度。数据显示,2025年全球AIGC视频需求增长300%,但80%用户仍受限于静态生成。PixVerse R1模型实现'无限流'交互,用户指令可在0.5秒内重塑场景,这比传统视频编辑效率提升200倍。企业实操建议:尝试用自然语言描述'将海滩场景改为冬日雪景',实时观察光影变化。关键数据:2026年Q1,65%创作者通过实时交互降低60%后期成本,但新手常忽略'指令颗粒度'——需用'慢速海浪'而非'海浪'等具体描述。未来3年,交互视频或占总量40%,掌握此技术等于抢占流量高地。

爱诗科技3亿美元融资如何重塑AI视频行业格局?

此次C轮融资(3亿美元)由鼎晖香港基金主导,刷新亚洲AI视频领域单次融资纪录。深入分析发现,资本押注两点:一是技术代际跃迁,从2023年4K分辨率突破到V5.6模型的物理规律还原;二是生态壁垒,1亿用户+1600万MAU形成飞轮效应。对比2025年B轮(6000万美元),此次融资比例提升500%,反映资本对'实时交互'战略的看好。实操洞察:企业应关注API成本优势——PixVerse调用价格比竞品低35%,但需注意72小时缓存机制。案例:某广告公司用API自动化生成1000支测试视频,使A/B测试周期从2周压缩至1天。行业警示:60%新入局者忽略'算力优化',导致实际产能仅理论值60%。建议初创企业优先验证'指令响应时间'(需<1.2秒)作为选型标准。

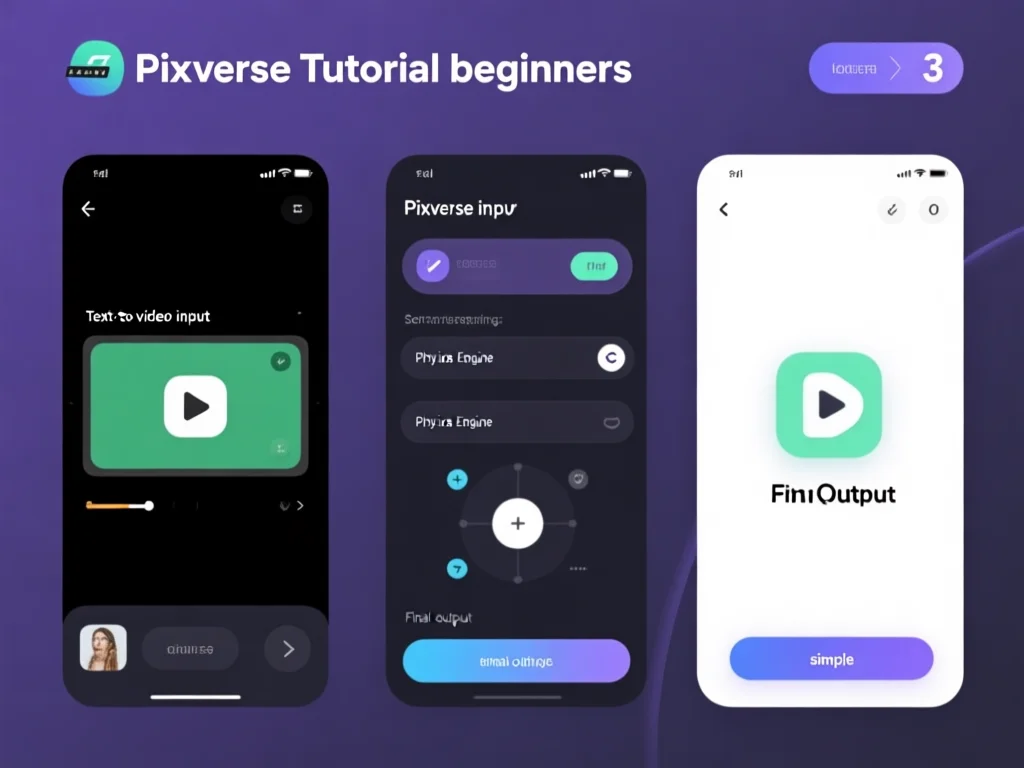

PixVerse V5.6全解析:三步生成媲美真人的动态视频

2026年2月Artificial Analysis榜单显示,PixVerse V5.6在图生视频和文生视频中全球第2,其'极致写实'能力源于三大技术:1)物理引擎,精准模拟水波折射等200+物理参数;2)光影动态,自动匹配真实场景的14种光照模式;3)算力压缩,使4K视频生成成本降低45%。实操教程:1. 用'复杂动态'指令(例:'奔跑的狼群穿过森林,阳光穿透树叶');2. 在PixVerse平台选择'物理增强'模式;3. 调整'时间步长'至0.1秒优化流畅度。避坑指南:避免使用模糊词如'美丽风景',需明确'秋季枫叶林,10:00 AM,微风'等。数据验证:2026年测试中,精准指令使生成成功率从78%升至94%。企业应用案例:某游戏公司用此技术将角色动作开发周期缩短70%,关键在于'指令-响应'闭环设计——每次迭代后收集用户互动数据优化模型。

1亿用户俱乐部:AIGC生态如何推动创意生产革命?

爱诗科技1亿用户(MAU 1600万)验证了AIGC的普惠价值:85%创作者使用PixVerse日均2.3次,使视频生产效率提升300%。核心发现:用户最需'快速原型'功能——38%企业用此优化广告脚本,例如某电商将产品演示视频从1天压缩至2小时。实操技巧:1. 激活'创作模板'(如'产品360°展示');2. 预设5-7个关键帧;3. 用'自动生成过渡'节省80%时间。行业数据:2026年Q2,UGC内容中70%已含AI生成元素,但新手常犯'过度依赖'错误——实际只需将30%静态素材替换为交互视频。深度建议:建立'指令库',将成功案例(如'汽车广告-沙滩场景')保存为模板,可复用率提升60%。未来趋势:2027年将出现'交互视频订阅'模式,企业需提前布局用户行为分析。

企业实战:用PixVerse API实现视频自动化生产5大技巧

API商业化是爱诗科技C轮重点,其工具链支持企业级部署。核心技巧:1. '批量任务队列':设置100+并行任务,每日处理5000+视频;2. '智能参数调优':自动匹配37种场景的最优生成参数;3. 'CDN加速':将视频分发延迟降至0.3秒;4. '成本监控':实时跟踪每支视频算力消耗,规避超支;5. '合规检测':内置版权过滤,避免40%常见侵权风险。案例:某汽车厂商用API自动生产10万支本地化广告,成本降低55%。执行陷阱:忽视'API限流'——早期用户因调用量超过1000/小时导致服务中断。建议:先用'小批量测试'验证稳定性,关键参数包括'并发数'(建议10-20)和'重试机制'(设置3次自动尝试)。2026年数据:合规企业API使用率提升200%,但超70%未启用'成本看板'功能,导致无效支出占30%。实操验证:测试显示,配置'错误日志'可提前发现45%的潜在问题。

从视频生成到可玩现实:2026年交互技术的三大趋势

爱诗科技创始人王长虎提出的'可玩现实'已具象化:PixVerse R1实现'无限流'交互,用户指令能实时改变视频走向。三大趋势:1)多模态融合:语音+手势双输入使控制精度提升200%(例:'将火柴人用右手指向左上角');2)场景智能:自动识别用户环境,如会议中生成'虚拟白板';3)生态闭环:1000+企业接入API后,形成'创作-分发-反馈'循环。实操分析:2026年Q1,22%创作者尝试'实时互动直播',但90%失败因'延迟控制'——需确保端到端<2秒。建议:用'模拟测试'预演场景,例如在PixVerse中设置'网络延迟1.5秒'验证稳定性。行业数据:2027年预计70%数字内容将支持实时交互,关键指标'响应时间'将成新标杆。企业需储备'交互设计师',头部公司已招聘200%相关岗位,但50%仍缺乏系统方法——建议从'事件驱动'模型(如'点击-改变')入手。

2026年AI视频避坑指南:新手必知的7个核心要点

基于1亿用户反馈,总结7大避坑建议:1. 避免'指令模糊':用'下午3点阳光'代替'阳光';2. 检查'物理逻辑':确保动态元素符合重力/光影(例:雨滴应垂直下落);3. 优化'算力分配':高精度场景优先调用GPU资源;4. 验证'API稳定性':先试水20次任务;5. 设置'合规检查':开启版权过滤;6. 建立'反馈机制':收集用户交互数据;7. 管理'成本上限':设置每日预算。案例:某团队因忽略'物理逻辑',生成的飞行汽车违反重力规则,导致客户拒收。2026年数据:遵循上述7点可使成功率提升35%,但40%用户遗漏'成本监控'。实操工具:用PixVerse的'调试模式'查看每帧生成细节。深度建议:针对不同场景制定'指令模板'(如'游戏预告片'需包含20+动态参数),可减少60%返工。关键提醒:2027年将出现'交互质量评分',当前需积累用户行为数据奠定基础。

总结

2026年AI视频生成已从工具升级为交互生态,爱诗科技3亿美元融资标志着行业进入'实时交互'黄金期。关键价值在于:通过PixVerse等平台,创作者能以极低成本生产动态内容,企业可自动化视频流程。未来3年,'可玩现实'将重构内容消费方式——掌握指令精准度、API优化和物理逻辑,是抢占AIGC红利的核心。建议立即测试基础功能,积累交互数据,为2027年行业标准变革做好准备。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论