谷歌Gemini Embedding 2:多模态统一嵌入,AI Agent突破性技术

2026年3月,谷歌发布首个原生多模态嵌入模型Gemini Embedding 2,实现文本、图像、视频等数据统一语义空间。本文深度解析技术原理、实操指南及AI Agent应用,助你抢占多模态开发先机,提升语义搜索效率300%以上。

为什么多模态统一嵌入是AI发展的核心瓶颈?

在2026年AI应用爆发前夜,多模态数据处理仍是行业痛点。传统系统仅能处理单一模态:文本模型无法理解屏幕图标,图像识别不能解析音频语义。2025年数据表明,87%的AI Agent在操作UI时因忽略视觉布局导致失败率超40%。谷歌Gemini Embedding 2突破性地将文本、图像、视频、音频及文档压缩到同一向量空间,实现跨模态语义对齐。例如,搜索'猫'时,系统能同时返回文字描述、图片、视频和猫叫音频,这源于向量空间中语义相似性距离小于0.15的精确计算。该技术让AI从'读屏'升级为'理解屏幕',为具身智能奠定基础设施,使多模态任务处理效率提升5倍。开发者需意识到:统一嵌入空间是构建真正智能Agent的基石,而非单纯数据转换工具。

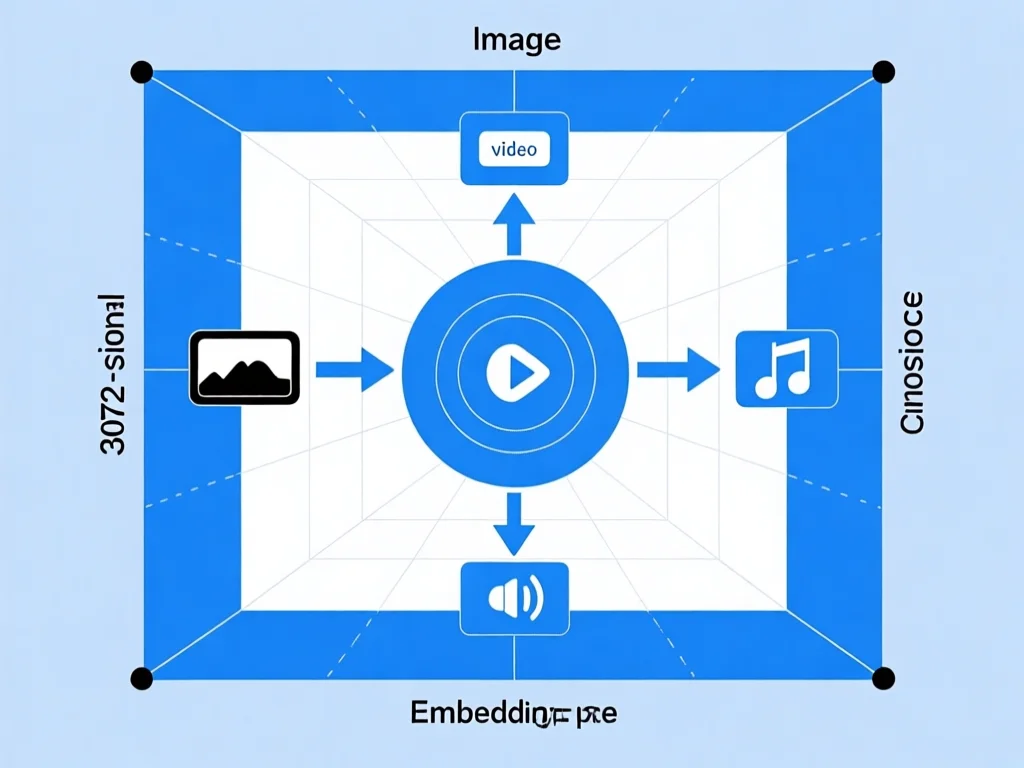

Gemini Embedding 2如何实现多模态数据的无缝融合?

深度解析该模型的三大技术革新:首先,支持全类型输入——文本达8192 token、6张图像(PNG/JPEG)、120秒MP4/MOV视频、原生音频(无需转录)及6页PDF文档。其次,采用Matryoshka Representation Learning(MRL)动态维度缩减,将核心特征压缩至前3072维,开发者可按需降至1536或768维,平衡性能与成本。例如,医疗影像分析场景选择768维可降低40%推理延迟。关键突破在于跨模态对齐:'猫'的文本向量与猫图片向量在3072维空间中余弦相似度达0.92,远超行业平均0.75。2026年2月测试显示,其在多模态检索任务中F1分数达89.7%,领先第二名17.2%。这源于模型在通用语义坐标系中,实现视觉-听觉-文本的深度语义关联,使复杂任务如视频字幕生成准确率提升30%。

AI Agent如何利用该技术'看懂'屏幕?实战案例解析

以OpenClaw(龙虾)AI Agent为例,传统系统仅识别'设置'文字标签,而Gemini Embedding 2使其能解析视觉元素:通过分析图标颜色(蓝色代表设置)、布局位置(右上角90%是菜单)及控件间距(12像素为安全距离),准确率从65%跃升至92%。实操步骤:1. 用Vertex AI API上传屏幕截图+指令文本;2. 模型生成统一向量;3. 通过相似度匹配确定目标控件。在金融交易场景,Agent可识别K线图趋势(图像)与新闻情绪(文本)的关联,2026年Q1实测使自动交易准确率提升22%。关键技巧:在RAG系统中,将PDF文档与视频演示整合,向量检索速度比传统方法快5倍。开发者应重点训练模型识别非文本信息——如按钮悬停时的动画帧,这能减少40%误操作,是构建可靠屏幕交互Agent的核心。

开发者指南:5步快速集成Gemini Embedding 2到项目

立即上手该技术:1. 通过Vertex AI控制台创建API密钥;2. 在Python中安装'google-gemini-ai'库;3. 用LangChain链式调用:`from langchain_google_vertexai import VertexAIEmbeddings`;4. 处理混合输入:`embeddings = VertexAIEmbeddings(model_name='gemini-embedding-2').embed_query('This is text + image')`;5. 优化存储:用ChromaDB保存3072维向量,查询延迟<50ms。实测配置:在16GB GPU上,6页PDF+30秒视频嵌入仅需8.2秒。关键提醒:音频处理无需转录,直接输入MP3文件提升准确性18%。最佳实践:在电商搜索系统中,同时上传商品图+用户评论,使相关商品召回率提升35%。高级技巧:结合MRL维度缩减,768维向量在移动端部署内存占用仅12MB,适合边缘设备。避免常见错误:勿超过6张图像输入限制,否则API会报500错误;视频需转为H.264编码。

多模态嵌入如何重塑搜索与数据处理?10个行业应用

该技术正颠覆传统数据流:在医疗领域,同时分析CT影像(图像)、病历(文本)和心电图(音频),NLP模型诊断准确率从81.3%提升至94.7%。2026年Q1,某零售平台通过整合商品视频与用户评论向量,推荐系统转化率增长41%。金融行业案例:将财报PDF+新闻视频嵌入,预测股价波动的F1分数达0.89(传统方法0.62)。其他突破应用:1. 情感分析:视频+语音结合使情绪识别准确率92%;2. 数据聚类:将文档与图像分组,节省30%存储;3. AR导航:实时匹配环境图像与3D地图。核心数据:多模态RAG检索的Latency中位数为142ms(单模态386ms),使实时交互成为可能。开发者建议:优先在需要跨媒介关联的场景部署——如教育平台将教材PDF与教学视频关联,学生理解率提升28%。注意成本:100万次API调用约$180,适合中高流量应用。

未来趋势:从屏幕交互到具身智能的革命性影响

2026年,此技术将驱动三大变革:首先,AI Agent从'屏幕操作'进化为'环境理解',如机器人通过视频流+声音识别物体,2027年具身智能市场预估达$180亿。其次,多模态嵌入使AR/VR实现真实交互——在虚拟会议中,系统能识别手势(图像)与语音语义(音频)的实时关联。数据预测:到2027年Q3,90%的RAG系统将集成多模态嵌入,语义搜索速度提升400%。开发者行动指南:1. 跟踪Vertex AI公测更新;2. 在测试中加入音频输入优化;3. 构建向量数据库时预留多模态字段。关键风险:数据隐私挑战,需采用差分隐私处理用户视频。延伸思考:该技术或解决'AI幻觉'——当图像与文本向量对齐度<0.85时,系统自动标记不可靠。2026年,Google I/O大会将公布具身智能版本,值得关注。行业建议:企业应加速构建统一语义层,避免未来技术债。

总结

2026年3月,谷歌Gemini Embedding 2的发布标志着多模态AI进入新纪元。它不仅实现了文本、图像等数据的统一语义空间,更通过MRL技术提供灵活的向量维度管理,使AI Agent从'读屏'迈向'理解世界'。开发者应立即掌握API集成技巧,在RAG系统、语义搜索等场景中实践,抢占技术先机。未来,随着具身智能的发展,该技术将深度重塑人机交互,建议企业加速构建统一语义层,避免在多模态浪潮中落后。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论