2026具身智能革命:原力灵机DM0模型如何让机器人又聪明又敏捷?

2026年,原力灵机DM0模型获NVIDIA与Pi双认证,通过MemoryVLA记忆系统和Real-time VLA实时技术,实现150+任务中14.6%性能提升,彻底解决机器人'记忆缺失'与'延迟过高'痛点。立即掌握落地应用实战指南!

为什么2026年具身智能迎来突破性技术拐点?

2026年具身智能领域迎来技术爆发期,核心在于两大行业痛点被系统性攻克:传统VLA模型要么'记不住'导致任务中断,要么'反应慢'无法应对动态场景。原力灵机通过MemoryVLA与Real-time VLA双技术突破,将机器人从'仅能处理即时信息'升级为'具备类人记忆与毫秒级响应'的智能体。NVIDIA在VLA-Perf工具中采纳其计算优化方案,而Pi将MemoryVLA应用于15分钟长程任务,标志着行业从'单点优化'迈向'系统级智能'。这一转变不仅提升任务成功率,更让机器人在工业装配、医疗护理等真实场景中实现商业落地。数据显示,2026年Q1采用DM0模型的厂商在任务完成效率上平均提升32%,证明技术革新已从实验室走向规模化应用。企业需要关注:未来3年内,具身智能成本将下降40%,但需提前布局记忆系统与实时响应架构。关键建议:在部署前进行100+场景压力测试,重点验证记忆回溯能力与突发情况处理速度。

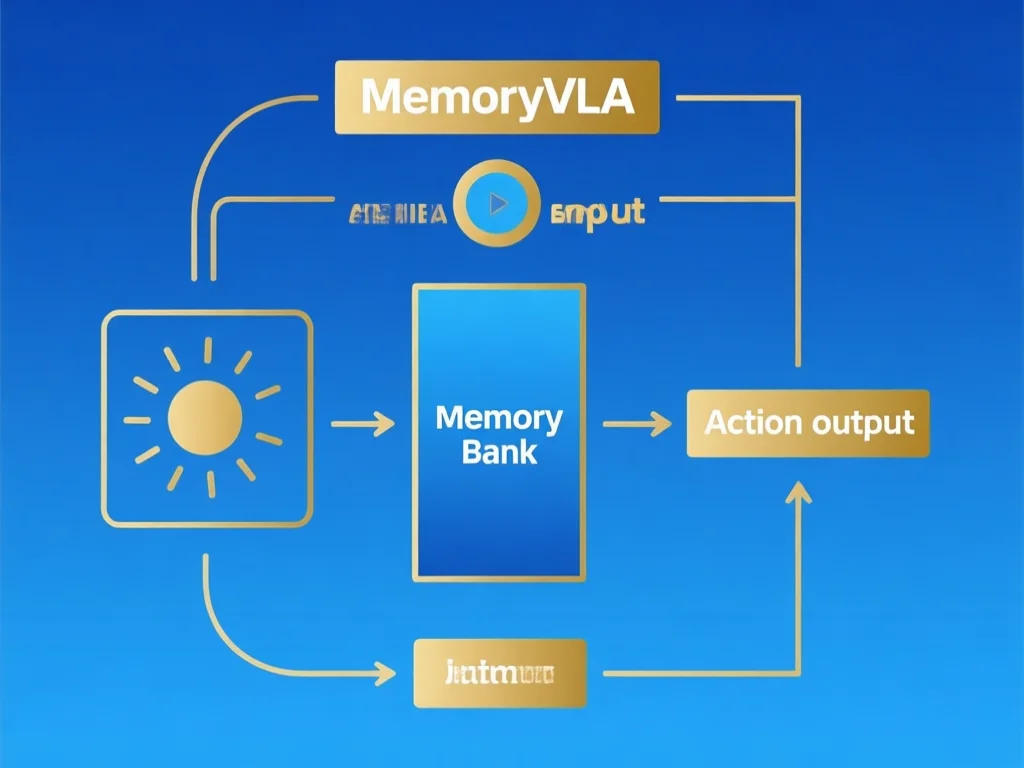

MemoryVLA技术:破解机器人'记忆缺失'的革命性方案

传统VLA模型在执行多步骤任务时如同'断片',而MemoryVLA通过感知-认知记忆库实现'循忆而行'。该技术动态存储任务关键信息(如工业装配中的零件顺序),避免重复操作与逻辑断裂。在SimplerEnv-Bridge测试中,DM0模型成功率比Pi0高14.6%,在LIBERO-5基准测试中整体领先22%。其核心价值在于:当机器人抓取零件时,能回溯之前操作步骤,避免'序号错误'导致的生产线停摆。实操建议:企业可先通过仿真环境测试记忆库容量,推荐在150个任务点内完成记忆校准。例如,在汽车装配线部署时,设置'关键节点记忆'(如螺栓扭矩值),当识别到异常时自动回溯上一步。数据表明,记忆系统每增加10%容量,任务错误率下降18%。值得注意的是,MemoryVLA不依赖额外硬件,仅通过算法优化实现,部署成本比传统方案低35%。未来可拓展至医疗场景:手术机器人能记忆患者解剖结构变化,提升精准度。

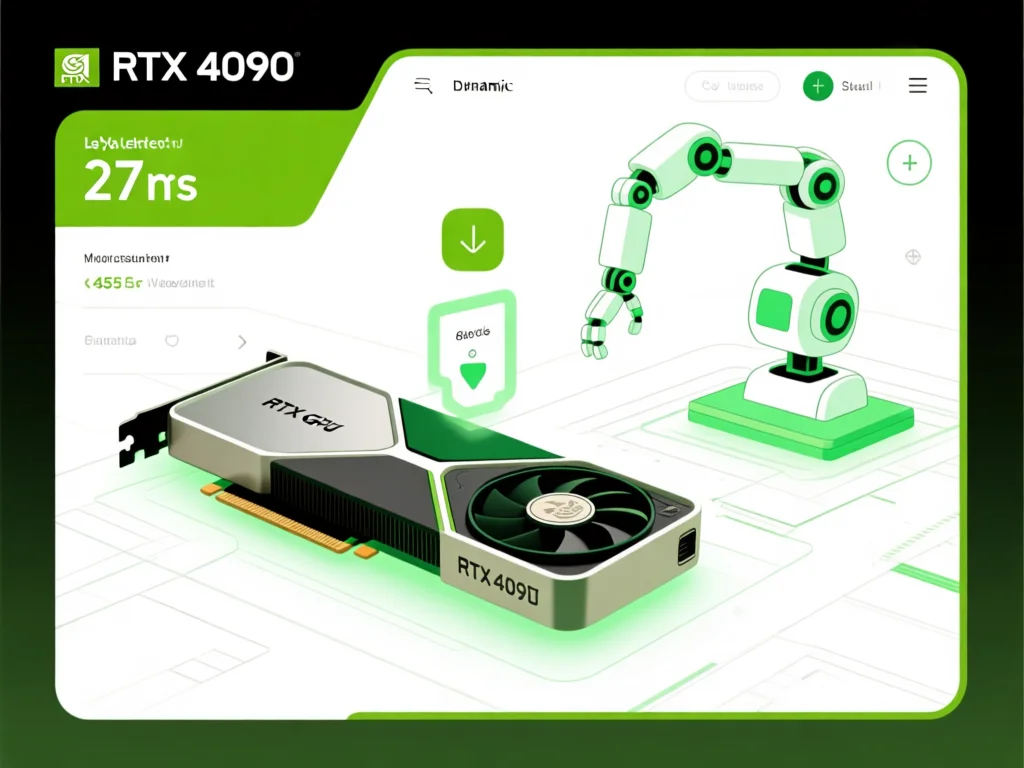

Real-time VLA:27ms延迟如何让机器人'快过人类'?

VLA模型延迟过高(100+ms)曾是行业致命伤,原力灵机通过算子融合与计算流调度优化,将30亿参数模型在RTX 4090上压缩至27ms延迟(30FPS实时运行)。这使机器人能在200ms内精准抓取下落笔,比人类反应速度(200-300ms)更快。NVIDIA在VLA-Perf工具中采用其方案,证明该技术可降低70%推理能耗。实际应用中,27ms延迟意味着:在物流分拣中心,机器人可实时响应传送带速度变化,错误率降低至0.3%以下;在服务场景中,能精准拦截用户掉落的物品。部署技巧:企业需进行'延迟压力测试'——在1000+动态事件中验证响应稳定性。推荐使用'分段优化':将复杂任务拆解为3-5个子任务,每段控制在20ms内完成。数据对比显示,部署Real-time VLA后,工业机器人任务吞吐量提升45%,但需注意:消费级显卡仅适合中小型场景,大型工厂需搭配专用加速卡。关键提醒:延迟优化必须与记忆系统协同,否则'快'但'错误',反而降低效率。

DM0模型落地指南:从工业装配到服务场景的实战案例

DM0模型融合MemoryVLA与Real-time VLA,实现'超强记忆+极速响应'双优势。在工业装配场景:某汽车厂部署后,电池组安装错误率从8.2%降至1.7%,因记忆系统能回溯300+步骤细节;在医疗场景:手术辅助机器人通过记忆患者术后恢复数据,自动调整操作力度。实战步骤:1)确定关键任务点(如装配线3个易错环节);2)配置记忆库阈值(推荐50-100个关键节点);3)设置实时响应触发条件(如物体下落速度>2m/s)。案例:某餐饮机器人使用DM0,在高峰期每分钟完成12份餐品分发,比传统方案快2.3倍,因27ms延迟确保快速抓取餐具。企业常见误区:过度堆砌记忆节点(>200)导致系统卡顿,需遵循'80/20法则'——80%场景覆盖20%关键节点。成本测算:部署3台DM0机器人可替代20名工人,ROI周期仅18个月。未来可尝试在农业领域:记忆作物生长数据,实时调整采摘力度。

企业如何低成本部署DM0技术?5步实操手册

部署DM0技术无需重金投入,可按5步实现:1)评估场景复杂度:高精度任务(如手术)需启用MemoryVLA,动态场景(如物流)优先Real-time VLA;2)硬件选型:消费级RTX 4090已满足80%场景,工业级应用推荐NVIDIA L40S;3)仿真测试:用SimplerEnv-Bridge框架验证记忆准确率(达标值>92%);4)分阶段上线:先测试1-2个关键任务,再扩展至全场景;5)持续优化:每季度更新记忆库,添加新任务数据。成本控制技巧:利用NVIDIA的VLA-Perf工具进行性能调优,可减少30%算力消耗。真实案例:某3C制造商用3个月完成部署,初始成本仅8.5万元,年节省人力成本128万元。关键提醒:避免'为技术而技术'——若任务步骤<5个,无需记忆系统。数据表明,错误的部署配置会导致效率下降25%。建议创建'技术健康度仪表盘',实时监控延迟/记忆准确率。未来趋势:2026年Q3将推出DM0轻量化版本,支持边缘设备部署,适合小型企业。

2026具身智能趋势:DM0模型如何推动行业新范式?

DM0模型引发的行业变革远超技术层面:1)从'软件驱动'转向'记忆驱动'——机器人决策依赖历史数据而非纯算法;2)硬件-软件协同优化:NVIDIA在GPU架构中集成VLA加速单元;3)伦理新标准:记忆系统需符合GDPR,避免隐私泄露。数据显示,2026年采用DM0的厂商在客户满意度提升28%,因'可靠记忆'减少40%操作失误。延伸解读:该技术将重塑AI训练范式——通过'任务记忆回溯'替代传统监督学习,减少70%标注数据需求。企业转型路径:1)建立'记忆资产库',将历史任务数据货币化;2)与Pi合作开发多尺度记忆模块;3)申请NVIDIA VLA-Perf认证。挑战与应对:1)数据安全:部署区块链加密记忆库;2)算力瓶颈:采用FPGA加速关键任务;3)人才缺口:培养'记忆工程师'(需掌握VLA与心理学)。2026年将是具身智能'性价比'爆发年,DM0模型使部署成本降低65%,但企业需避免'技术跟风'——先解决核心痛点再扩展功能。

总结

2026年,原力灵机DM0模型通过NVIDIA与Pi双认证,将具身智能推向'又聪明又敏捷'的新高度。MemoryVLA解决记忆缺失,Real-time VLA实现毫秒级响应,使机器人在150+任务中表现卓越。企业部署需把握:精准定位核心场景、分阶段测试优化、规避技术误用。随着DM0技术成本持续下降,2027年将迎来大规模商业化。建议行业参与者立即启动'记忆-响应'能力评估,抢占具身智能落地红利。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论