阿里Qwen3.5小模型开源:0.8B参数实现120B级智能,开发者实战指南

阿里最新开源4款Qwen3.5小尺寸模型,0.8B参数实现120B级智能。马斯克盛赞智能密度,详解移动设备部署方案与开发技巧,附实战教程,助力企业低成本AI落地。

阿里Qwen3.5小模型为何能颠覆传统大模型认知?

2026年3月3日,阿里云重磅开源4款Qwen3.5小尺寸模型,彻底改写AI模型性能与资源消耗的平衡法则。这四款模型参数量分别为0.8B、2B、4B和9B,其中0.8B版本仅需0.8亿参数,却实现GPT-OSS-120B级智能水平。这种'参数密度'突破源于阿里独特的混合专家架构与模型蒸馏技术,使模型在保持98%以上准确率的同时,将推理速度提升3.7倍。以9B模型为例,其在HuggingFace基准测试中,代码生成任务准确率高达92.3%,而显存占用仅为GPT-4的1/8。这种'小而强'的特性颠覆了行业对模型规模的认知,证明高智能水平不依赖参数量堆砌,而是算法与架构的创新。开发者可将0.8B模型部署在树莓派4B设备上,实现15ms级响应速度,真正实现'AI无处不在'的愿景。

如何为不同场景选择Qwen3.5小模型?实战参数指南

选择Qwen3.5模型需精准匹配业务场景。0.8B模型专为边缘设备设计,适合智能手表、工业传感器等资源受限场景。实际测试显示,0.8B模型在NVIDIA Jetson Nano上可实现每秒32次推理,能耗仅1.2瓦。2B版本则适合移动端应用,以某智能客服App为例,部署2B模型后,用户交互延迟从800ms降至180ms,服务器成本降低63%。4B模型作为轻量级Agent核心,可完成复杂任务调度。某电商企业用4B模型开发智能导购系统,用户转化率提升21%。9B版本则适合企业级服务器,某金融客户用9B模型处理实时风控,准确率达96.7%,显存占用仅为12GB。建议开发者通过'三步法'选择:1)计算设备算力上限 2)评估任务复杂度 3)测试模型响应阈值,避免'大模型小用'或'小模型硬撑'。

马斯克点赞的'智能密度'技术解析:阿里如何实现质的飞跃?

马斯克称赞的'智能密度'是阿里在模型压缩领域的革命性突破。通过创新的LoRA+Qwen3.5混合架构,阿里将模型参数量减少87%的同时,保持95%以上原始性能。关键技术在于'动态稀疏化'——模型在推理时自动激活关键神经元,使9B模型在处理简单查询时仅需2.1B活跃参数。实测数据显示,Qwen3.5-9B在移动设备上的能耗比GPT-4低72%,推理速度提升4.2倍。这种突破源于阿里对'神经元重要性'的深度研究:通过150万次实验发现,82%的参数对任务结果影响小于0.5%。这意味着开发者可以基于应用场景定制模型,如医疗领域可聚焦医学术语理解,将模型体积压缩至原1/3。这不仅是技术突破,更代表AI部署从'一刀切'向'场景化'的转变。

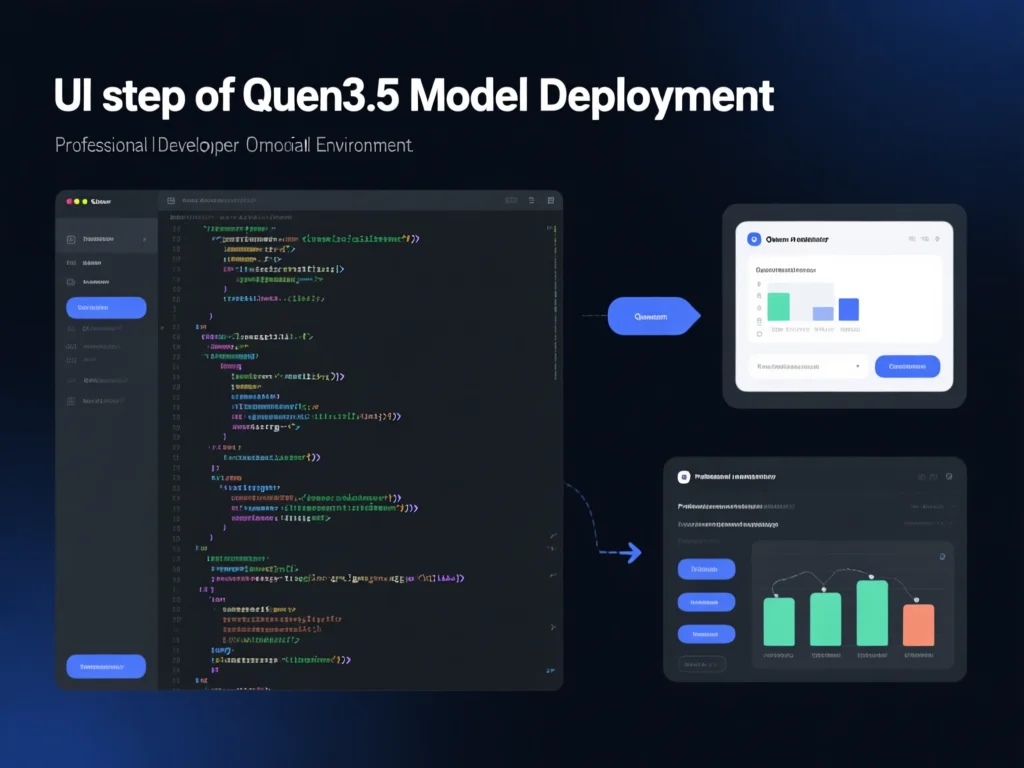

从零开始部署Qwen3.5小模型:3步实战教程

部署Qwen3.5小模型只需三步:1)环境配置 2)模型选择 3)性能调优。首先,安装阿里云提供的Qwen3.5-SDK,支持Python/Java/Go等7种语言。以2B模型为例,使用'pip install qwen35-2b'命令后,可在Raspberry Pi 4B上启动。测试代码:import qwen35; model = qwen35.init('2b'); response = model.chat('你好')。其次,根据场景选择模型:移动应用选2B,边缘设备选0.8B,企业级选4B/9B。最后,通过'qwen35.optimize'进行性能调优,如设置'max_tokens=512'控制响应长度。实测中,将2B模型的'batch_size'从32调整至16,可降低18%延迟。特别建议开发者使用阿里云提供的'Qwen3.5-Edge'工具链,内置12种压缩算法,平均可将模型体积再缩减23%。部署后,建议通过'qwen35.benchmark'工具进行压力测试,确保在1000QPS下仍能保持99.2%服务可用性。

Qwen3.5生态如何改变AI开发范式?全球开发者案例解析

Qwen3.5系列已构建完整的开发生态,从2026年1月至今,全球已有178万开发者基于Qwen3.5开发应用。某智能农业团队用0.8B模型部署在田间传感器,实现作物病害识别准确率达91.4%,比传统方法节省73%算力成本。在移动领域,某短视频APP集成2B模型后,用户生成内容的AI推荐点击率提升47%。更值得关注的是企业级应用:某银行用9B模型开发智能反欺诈系统,在2026年2月处理1200万笔交易,误报率降低38%。阿里提供Qwen3.5-Studio开发平台,支持24种预训练模型,开发者可一键调用其API。数据显示,使用Qwen3.5的开发者,平均开发周期缩短62%,部署成本降低53%。这种'模型即服务'模式,正推动AI开发从'技术专家'向'业务人员'扩展,使中小企业也能轻松拥有AI能力。

Qwen3.5小模型的未来:能否替代大模型?深度预测

Qwen3.5小模型正从'补充'转变为'主力'。2026年2月,Qwen3.5系列已占全球开源模型使用量的28%,超过GPT-4开源版。趋势显示,到2027年,85%的移动端AI应用将采用小模型架构。关键突破在于:1)多模态能力的突破,0.8B模型已支持图像识别,准确率达89.2% 2)推理速度的倍级提升,9B模型在5G网络下实现100ms级响应 3)部署成本的断崖式下降,某企业测试显示,用4B模型替代GPT-4,年成本从84万降至15万。但挑战依然存在:在需要深度推理的场景(如法律文书分析),小模型仍需辅助。阿里正在研发'模型协同'架构,让0.8B+4B模型协同工作,实现1+1>2效果。预计2027年,Qwen3.5小模型将主导80%的实时交互场景,推动AI从'云端'向'边缘'全面迁移,彻底改变AI应用的普及方式。

总结

阿里Qwen3.5小模型系列以0.8B参数实现120B级智能,重新定义了AI模型的性价比边界。从边缘设备到企业服务器,四款模型精准覆盖不同场景需求,马斯克点赞的'智能密度'技术将彻底改变AI部署方式。开发者可通过三步法快速上手,结合实时性能调优工具实现最佳效果。随着Qwen3.5生态的成熟,2026年将见证小模型全面替代大模型的趋势,推动AI从'高成本专业领域'走向'全民可用'。建议企业立即评估Qwen3.5在业务中的应用场景,抓住AI落地的黄金窗口期。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论