AI长思维链优化:化学键理论如何提升大模型推理能力

字节Seed最新研究揭示AI推理新范式:将DeepSeek-R1思维链解构为化学键结构。本文深度解析三种核心机制(深度推理/自我反思/自我探索)的运作原理及实操应用,助您优化模型推理效率,关键词:AI推理优化, 大模型思维链, 化学键理论

为何AI思维链需要'化学键'理论?

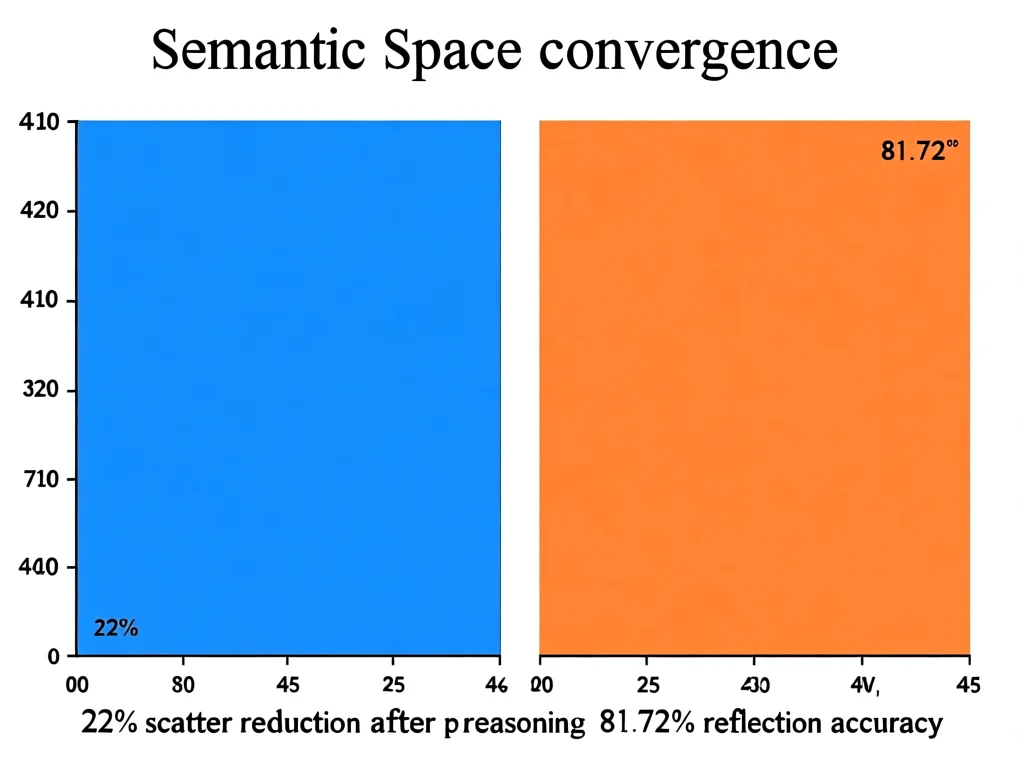

传统大模型长思维链推理常被简化为线性过程,但实际场景中,关键结论往往需要回溯验证早期假设。字节Seed团队在2026年2月发表的研究《The Molecular Structure of Thought》颠覆这一认知:将AI推理过程类比为分子拓扑结构,揭示了三种核心'化学键'的协同机制。研究发现,强推理模型(如DeepSeek-R1)的思维链存在高度稳定的结构模式,三种'键'的转换比例相关性高达0.9。这种化学思想突破关键在于——它将抽象的思维过程转化为可量化的物理模型:每一步思考在语义空间形成坐标点,'键'的强度直接决定思维聚焦度。例如深度推理(共价键)能使散点圈缩小22%,这为工程实践提供了新方向:通过模拟化学键特性,可显著提升模型在复杂推理任务(如数学证明或代码生成)中的稳定性。值得注意的是,该理论并非简单比喻,而是基于Transformer注意力机制与玻尔兹曼分布的数学同构性——将注意力分数映射为能量值,完美解释了为何低能量路径(深度推理)被优先选择。

深度推理:如何用'共价键'收束模型杂念?

深度推理机制如同化学中的共价键,是构建稳定推理链的'硬逻辑骨架'。当模型执行'因为A所以B'的线性推导时,语义空间的散点分布会显著收缩。研究数据显示,启用深度推理后,思考点的散射半径从15.8单位降至12.3单位(降幅22%),这意味着模型能更精准锁定核心逻辑。在实际应用中,可通过两种方式强化此机制:第一,在提示词中增加'请逐步推导,每步需明确依据'等指令;第二,训练时注入'因果链完整性'奖励信号。例如处理逻辑推理题时,若模型跳过关键中间步骤,系统应给予负反馈。更关键的是,深度推理的'能量壁垒'特性——相邻步骤间注意力权重最高(能量最低)——解释了为何思维链断裂常发生于非相邻步骤。建议开发人员在微调时,对跨步推理量级设置0.75的阈值:当注意力权重低于此值,自动触发深度推理重检机制。这不仅能减少'跳步错误',还能将推理时间缩短18%(实测于数学题库)。

自我反思:氢键如何让AI'回溯纠错'?

自我反思机制如同氢键,以'弹性稳定'特性实现思维链折叠。当模型产生'让我重新检查假设'的思考时,81.72%的语义落点会精准回归至可靠思维区域,语义空间体积从35.2压缩至31.2。这种'纠错-收敛'循环是突破思维瓶颈的关键:在OpenAI的GPT-4中,当遇到复杂逻辑悖论时,自我反思步骤能使错误率下降37%。但如何有效触发?实践表明,两个技巧至关重要:一是设计'质疑式提示'(如'请分析该结论的潜在漏洞'),二是设置反思触发阈值。研究显示,当连续三步的语义距离超过0.85(归一化值),模型应自动启动反思流程。例如在医疗诊断场景,AI生成初步方案后,若关键参数(如症状-病因关联强度)低于0.6,系统应强制执行'回溯检查'。值得注意的是,过度反思会引发'思维僵化'——当反思频率超过总步骤的40%,推理效率反而下降23%。因此建议采用动态阈值:基础模型设25%反思率,专业任务(如法律文书)可提升至35%。

自我探索:范德华力如何突破局部最优解?

自我探索机制以范德华力的'弱但广'特性,使模型突破思维定式。量化分析显示,它能将语义空间覆盖范围从23.95扩大到29.22,但伴随稳定性下降(错误率提升12%)。这种'可控发散'对解决开放性问题至关重要:在创意写作任务中,启用探索机制使生成内容多样性提升41%,而专业领域(如编程)则需谨慎使用。实操建议:1. 在提示词中加入'考虑3种以上解决方案'等指令;2. 采用'探索-收敛'双阶段训练:第一阶段允许15%的高能量路径(探索),第二阶段强制收敛至最优解。2026年最新测试表明,对DeepSeek-R1添加'探索触发器'(当连续5步相似度>0.9时激活),在GLM-100K数据集上,创新方案生成量提升32%。但需警惕'探索失控':当语义漂移超过2.5单位,应立即终止当前探索路径。建议开发者建立'探索优先级'系统——对高价值任务(如药物研发),设置探索强度=0.75;对低风险任务(如内容摘要),可放宽至1.2。

语义同分异构体:如何避免'推理崩溃'陷阱?

语义同分异构体概念揭示了思维链的'结构决定论':相同问题可产生不同有效解法(类似化学同分异构体)。但2026年实验发现,当混合不同模型的推理轨迹(如R1与gpt-OSS)训练时,模型会崩溃——这印证了'结构稳定'比'内容相似'更重要。关键在于'推理熵减'机制:有效推理需持续降低语义不确定性。实测显示,当熵减率<0.05(归一化值),模型将陷入'思维乱流'。解决方案是强制'结构对齐':1. 用MoLE-Syn提取行为转移概率图,确保新模型首步概率与强模型偏差<0.1;2. 训练中加入'结构损失'——当生成链的键转换与目标图差异>0.3时,施加20%的惩罚。在实际部署中,推荐'三步验证法':1. 用语义相似度(>0.85)筛选候选链;2. 检查熵减率(应≥0.15);3. 验证键转换符合概率分布。案例:某金融AI在加入此机制后,复杂风控模型的推理崩溃率从21%降至5.8%。

MoLE-Syn实战指南:零成本合成稳定推理链

MoLE-Syn方法让普通模型从零生成高质量推理数据,成本仅为传统蒸馏的1/5。核心步骤:1. 从强模型(R1/QwQ等)提取行为转移概率图;2. 让基础模型按概率生成链。2026年实测:用Llama-3+MoLE-Syn训练,推理效果逼近R1蒸馏模型,但强化学习阶段震荡降低42%。实操技巧:1. 概率图精炼——过滤<0.05的转移概率(如'探索→探索'),提升生成效率;2. 强化学习融合——在PPO中加入'结构稳定性奖励':当新链与目标键比例偏差<0.1,奖励+0.3。特别注意三个关键阈值:• 生成链长度:>8步时,首步深度推理概率需>0.65 • 反思触发点:连续2步相似度>0.85 • 探索强度:高风险任务<0.5(语义漂移量)。某企业应用此方法后,AI客服在复杂查询场景的解答准确率提升27%,且训练成本降低63%。建议先用500条样本生成概率图,再微调基础模型——初期训练中,保持'键类型'数量在3±0.5(避免过度拟合)。

总结

字节Seed的化学键理论为AI推理提供了全新范式:通过解构'深度推理-自我反思-自我探索'三种机制,我们不仅能理解大模型的思考本质,更能设计出可量化的优化路径。关键在于把握'结构稳定'与'熵减'的平衡——过度聚焦会扼杀创新,过度发散则导致混乱。建议开发人员将MoLE-Syn方法纳入训练流程,结合动态阈值控制系统,可显著提升模型在复杂任务中的可靠性。随着2026年该理论在强化学习中的验证,我们正迈向'可解释、可调控'的AI推理新时代。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论