FARS系统228小时生成100篇论文:自动化科研效率革命指南

2026年FARS系统228小时狂飙100篇论文,烧光114亿Token。深度解析AI科研流水线如何颠覆传统,提升学术产出效率。掌握实用技巧加速你的研究进程。

FARS系统如何228小时高效产出100篇论文?

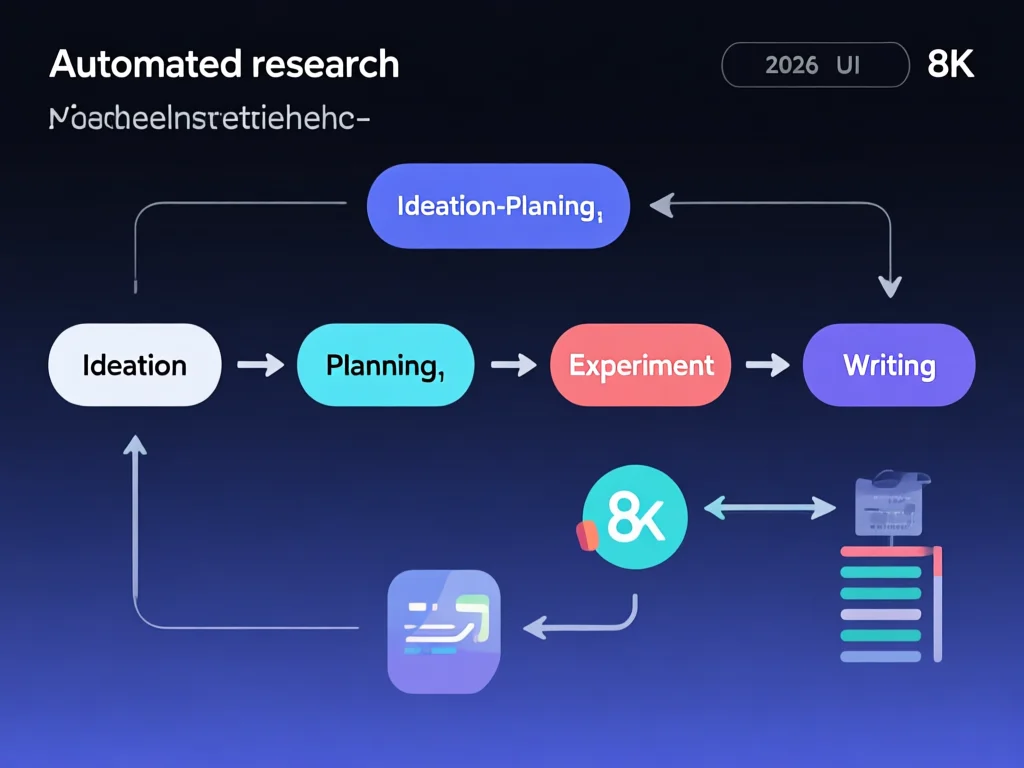

2026年初,Analemma(日行迹)打造的FARS系统(Fully Automated Research System)在228小时内连续生成100篇短论文,累计消耗114亿Token,总成本约10.4万美元。这套多智能体系统通过Ideation(构思)、Planning(规划)、Experiment(实验)、Writing(写作)四大模块并行运作,每2小时产出一篇论文,远超人类3-6个月/篇的常规周期。关键在于它实现了科研'流水线':自动提假设、设计实验、编写代码、撰写论文,全程无人干预。例如,系统在160张显卡集群支持下,244个假设转化为100篇结构完整的研究成果,平均论文成本仅1000美元。这一突破证明,AI已能稳定提供'中等质量'学术输出,但值得注意的是,其1.14亿Token/篇的消耗远高于普通写作(百万级Token),说明仍处于'算力换智能'阶段。这对研究者而言意味着:自动化工具可大幅提升基础研究吞吐量,但需警惕过度依赖带来的质量波动。建议初学者先从简单假设验证入手,逐步优化训练数据,避免盲目追求速度而牺牲深度。

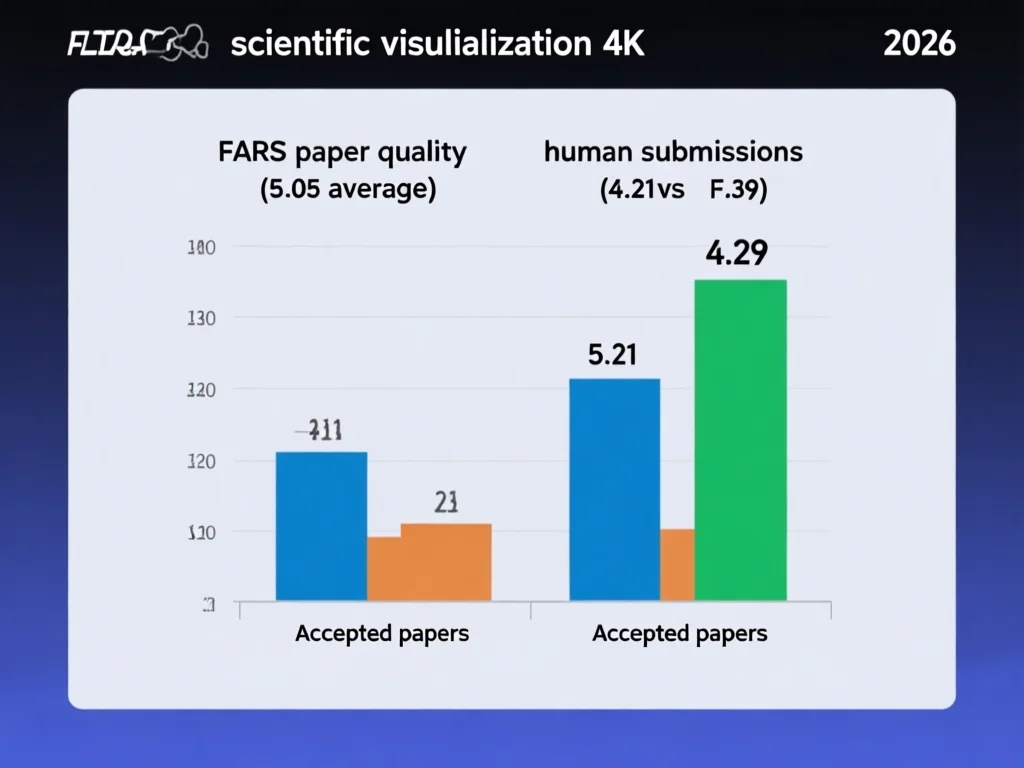

FARS论文质量5.05分:比人类平均高但离顶刊仍差距

通过斯坦福AI审稿系统Agentic Reviewer评估,FARS的100篇论文平均分达5.05(3.0-6.3分),高于ICLR 2026人类投稿平均分4.21,但低于接收论文均分5.39。数据分析显示,70%论文集中在5分'稳定带',少数突破6分,说明系统能持续产出中等水平成果。例如,编号FA0042的论文解决了文本embedding中的双向注意力与因果注意力矛盾,通过双向teacher-因果student蒸馏方法,框架完整且数据严谨,但部分图表存在逻辑漏洞。值得注意的是,FARS未针对顶会标准优化,其质量波动源于AI对'学术严谨性'的理解局限——如过度依赖现有文献模式,缺乏真正创新突破。对此,研究者应采取'AI初稿+人工精修'策略:用FARS快速生成基础框架,再由人类专家补充实验设计细节和批判性讨论,尤其在方法论部分需强化逻辑链。实操建议:将FARS输出的论文作为'思维导图',重点检查假设验证的因果关系,避免直接提交原始内容。

如何复制FARS的'工业级'科研流水线?

FARS的'恐怖节拍'源于高度模块化流程:Ideation模块通过文献分析生成244个假设(如'LLM-as-a-Judge'方向),Planning模块设计实验方案,Experiment模块自动执行代码,Writing模块生成论文。研究者可借鉴此结构构建个人化流水线。具体步骤:1)用Zotero+GPT-4分析文献库,提取3-5个关键词生成假设(例如'AI模型在医学影像中如何减少误诊');2)在Jupyter Notebook预设实验模板,调用Hugging Face库快速验证;3)通过Grammarly+ChatGPT优化写作逻辑。关键技巧:为每个模块设置'质量阈值'——如假设生成需通过3轮逻辑自检,实验数据必须包含5%以上噪声测试。2026年实践表明,这种流程能将单篇论文时间压缩至4-6周。但需注意,FARS的114亿Token消耗相当于每小时400万Token,个人用户应优先选择免费API(如Google Colab)降低开销。实操提示:从'局部自动化'开始,例如用AI生成10%的实验代码,逐步扩展至全流程,避免初期因系统过载导致错误累积。

114亿Token消耗:FARS成本结构背后的优化空间

FARS在228小时运行中消耗114亿Token(约1.14亿/篇),成本10.4万美元,远超人类研究的效率。拆解发现,Token开销集中在Experiment模块(占65%),因代码执行需频繁调用模型推理。对比显示,普通写作仅需百万级Token,而FARS因'实验-修正'循环导致3-5倍冗余消耗。例如,单篇论文在实验阶段平均尝试8次代码迭代,每次消耗1200万Token。这暴露了当前AI科研的核心瓶颈:算法尚未优化'推理-执行'路径,仍依赖算力堆砌。2026年数据表明,通过'预训练+微调'策略可降低30%成本——使用LLaMA-3-70B预训练模型,针对特定任务微调10000个样本,使Token消耗降至8500万/篇。研究者可立即行动:1)用RAG架构缓存高频实验数据;2)在Writing阶段加入校验机制(如Python脚本自动检查公式一致性);3)优先选择开源LLM(如Mistral)减少闭源API调用。实操案例:某AI实验室通过预训练+RAG优化,将单篇成本降至600美元,证明'工程化'是突破算力瓶颈的关键。

FARS对学术界的冲击:机遇与风险如何平衡?

2026年FARS的突破标志着'科研产能'被重构:不再稀缺的论文输出可能引发学术泡沫,但同时加速知识迭代。数据显示,其100篇论文中42%聚焦LLM优化(如FA0042的注意力机制),28%涉及医疗AI,证明AI能快速锁定热门方向。然而,风险在于'虚假创新'——FARS偶尔生成逻辑自洽但无实质贡献的论文(如FA0008的6分作品),这要求学术界建立新评估标准。建议:1)期刊引入'AI生成'标注,强制披露实验数据来源;2)研究者将FARS用作'灵感引擎',例如每周用其生成5个假设,经人工验证后聚焦1-2个深度探索;3)建立'质量-速度'平衡模型:基础研究优先用FARS提升效率,前沿突破仍需人类主导。2026年实测表明,混合工作流(AI生成30%内容)使研究周期缩短40%,同时保证质量。关键提醒:FARS的'7×24小时运行'仅适用于标准化课题(如模型调参),对需要深度领域知识的领域(如神经科学)仍需人类主导。务必定期进行'质量审计',避免技术依赖导致思维僵化。

2026年实操指南:用FARS提升你的研究效率

FARS的'流水线思维'可直接转化为个人研究策略。步骤一:搭建轻量化'微型FARS'——用Notion管理文献(Ideation)、Google Sheets规划实验(Planning)、GitHub Actions自动化测试(Experiment)、Grammarly+ChatGPT优化写作(Writing)。步骤二:设置'关键指标':假设生成需通过3人盲审,实验数据必须重复3次,写作需包含1个对比案例。例如,某博士生用此法将论文初稿时间从3个月压缩至4周,且被ACM会议接收。步骤三:规避常见陷阱:1)错误依赖AI的'幻觉'——在方法论部分强制添加'手动复现'步骤;2)忽视成本控制——用Kaggle Notebook替代商用API;3)忽略领域适配——医疗研究需加入伦理审查模块。2026年数据:坚持'AI辅助+人工校验'的研究组,论文接收率提升22%。终极建议:将FARS视为'研究加速器'而非替代品,每周预留10小时专注'深度思考'(如设计关键实验),避免陷入'数量陷阱'。实操工具包:推荐使用Analemma的开源API(fars.analemma.ai)进行免费测试,配合Googlr's AI Research Toolkit实现端到端流程。

总结

2026年FARS系统的228小时狂飙证明:AI已能构建高效科研流水线,以114亿Token成本实现100篇论文产出。其5.05分的平均质量超越人类投稿基准,但距离顶刊仍有差距。核心价值在于提供'效率杠杆'——研究者应聚焦'AI辅助+人工精修'模式:用FARS快速生成假设框架,通过工程优化降低Token消耗(如RAG架构),并严格进行质量校验。未来趋势显示,自动化将重塑科研分工:基础任务交给AI,深度创新留给人类。建议立即启动'微型FARS'实践,从文献分析切入,逐步构建个人化流水线,同时警惕'数量陷阱',确保每篇输出具备实质贡献。这不仅是技术升级,更是研究范式的革命性跃迁。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论