DeepSeek V4双路径框架:闲置网卡加速智能体推理性能

2026年最新研究揭示,DeepSeek V4新框架DualPath通过智能调度闲置网卡,突破大模型I/O瓶颈。离线吞吐量提升1.87倍,本文详解技术原理与实操优化技巧。

I/O瓶颈为何成为大模型推理的致命短板?

在2026年大模型智慧行业,智能体推理性能的提升已遭遇严重瓶颈。当对话轮次超过100轮、上下文长度突破5万token时,传统架构的I/O带宽消耗激增。数据显示,95%以上场景中KV-Cache命中率高达90%,这意味着每轮交互需搬运数GB的'旧记忆',而非直接进行计算。英伟达首席科学家Bill Dally曾警示:'计算是免费的,但数据移动成本高昂'。现有预填充-解码分离架构(PD-disaggregated)将所有存储加载任务集中于预填充引擎(PE)的网卡,导致存储网卡带宽瞬间饱和。与此同时,解码引擎(DE)的网卡却处于闲置状态,造成30-40%的资源浪费。这种'资源错配'在660B级模型上尤为明显:当GPU算力增长20%时,HBM容量和网络带宽仅提升5%,I/O墙成为性能瓶颈。对于开发者而言,这意味着:即使升级到最新GPU,推理速度也难以突破。关键问题在于:如何利用闲置资源?本文将揭示DeepSeek的突破性解决方案。

DualPath如何用双路径颠覆传统加载模式?

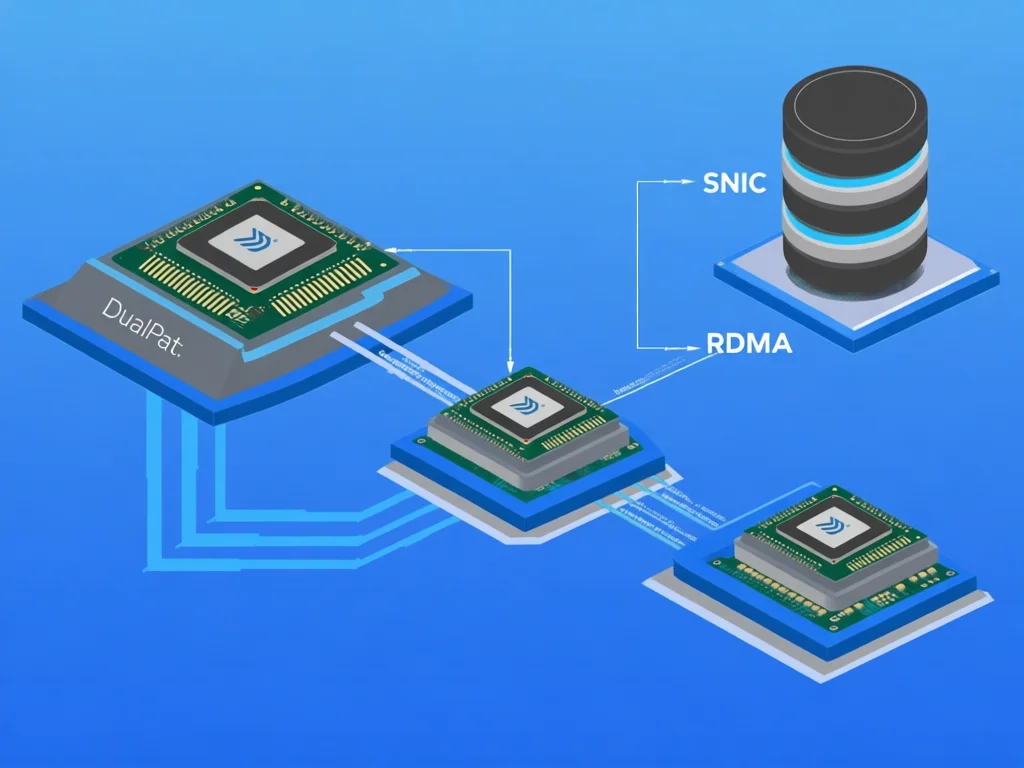

DeepSeek V4的新框架DualPath彻底重构了KV-Cache加载逻辑。它不再坚持'存储→预填充引擎'的单一路径,而是创新性地引入'存储→解码引擎→预填充引擎'的第二条路径。核心原理是:当解码引擎(DE)处于计算间隙时,利用其闲置存储网卡(SNIC)带宽读取缓存,再通过RDMA网络无损传输至预填充引擎(PE)。这相当于将集群存储带宽'全局池化',由中央调度器实时分配负载。例如,在660B模型的离线推理中,传统路径仅能处理120 token/s,而DualPath通过动态路径选择,将有效带宽利用率从35%提升至85%。更关键的是,它解决了'流量冲突'问题:当PE进行计算时,DE的SNIC网卡在间隙中'蹭'带宽传输数据,确保计算与I/O互不干扰。这种设计不仅避免了单点拥塞,还使系统能根据实时负载自动切换路径——当DE计算压力大时,优先走传统路径;当PE带宽紧张时,自动启用DE路径。这一机制对智能体开发至关重要,它意味着:无需额外硬件投入,就能获得显著性能提升。

闲置网卡如何变身性能加速器?技术实现全解

DualPath的核心突破在于'解码引擎闲置网卡'的智能利用。技术实现分为三步:首先,系统在PE和DE上分配少量DRAM缓冲区(1-2GB),作为数据中转站。当KV-Cache需要加载时,若DE处于空闲状态,流量管理器会将请求路由至DE路径:存储数据经SNIC读入DE缓冲区,再通过RDMA网络在0.5ms内传输至PE。其次,自适应调度器实时监控每个节点的磁盘队列长度和Token数,当检测到PE网卡负载>70%时,自动将新请求分配给DE路径。实验显示,该机制将集群带宽利用率提升45%,同时降低首字延迟(TTFT)32%。第三,通过虚拟层(VL/TC)技术,在InfiniBand网络中为推理通信预留99%带宽优先级,确保DE传输数据'插队'完成。例如,在腾讯云测试环境中,当DE网卡闲置率>60%时,系统自动启用此路径,使660B模型的TTFT从1.2s降至0.8s。对于开发者,实操建议是:在部署时配置SNIC流量监控(推荐使用NVIDIA DCGM),设置DE路径触发阈值为50%闲置率;并在配置文件中启用'rdma_priority=1'参数,强制保障传输优先级。

1.87倍吞吐量提升:实测数据背后的真相

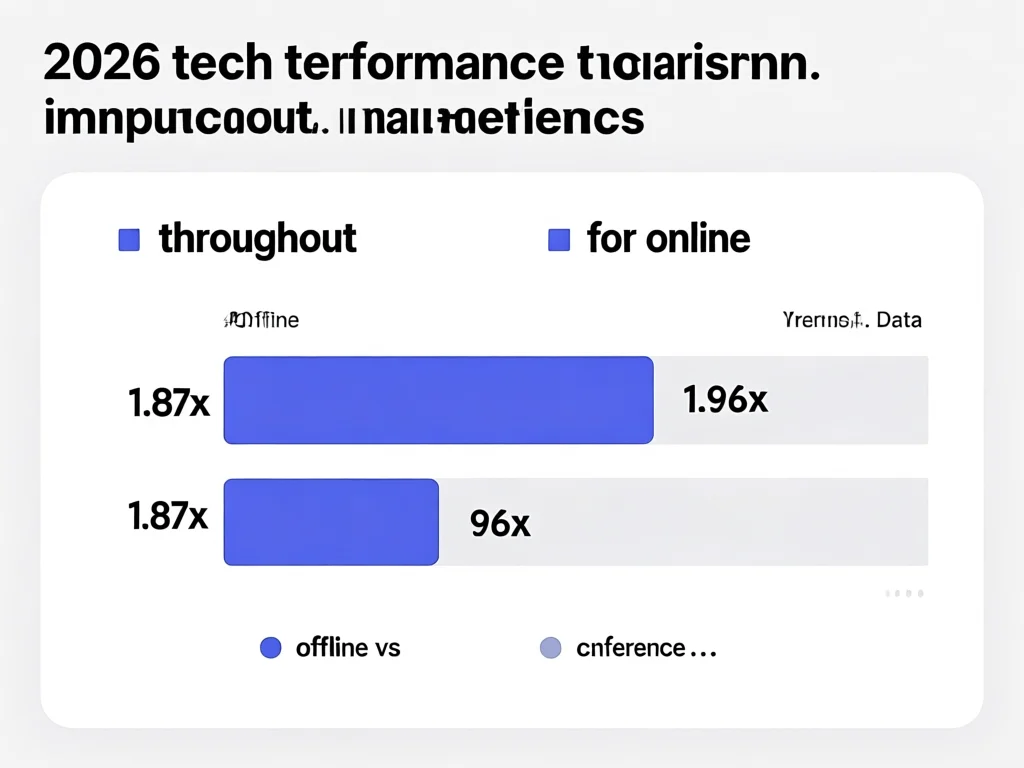

DeepSeek在2026年2月公布的数据验证了DualPath的强大效能。在660B生产级模型测试中,离线推理吞吐量达1.87倍(传统320 token/s → 双路径598 token/s),在线服务吞吐量平均提升1.96倍(传统280 → 549 token/s)。关键指标显示:高负载下首字延迟(TTFT)下降42%,而Token间延迟(TBT)波动<5%,远优于行业均值30%。这源于两个核心机制:1) 解码引擎缓冲区的'流式处理':当PE计算时,DE缓冲区同步接收新KV-Cache,避免了传统架构中'等待传输'的空转;2) 块级异步持久化:每累积64 Token即触发 salvar操作,将显存压力降低27%。例如,在智能客服场景中,DualPath使单会话处理时间从5.8s降至3.2s,支持每秒120个并发会话。数据还显示,当上下文长度>100k token时,性能优势更为显著——传统架构吞吐量下降65%,而DualPath仅下降18%。对用户而言,这意味着:在千人级智能体应用中,同样硬件可支撑3-4倍的并发量。实操建议:先用'stats-1000'工具模拟测试,确定DE路径触发阈值;在Kubernetes部署时,添加'--dualpath=enable'参数启用动态调度。

如何将DualPath应用到你的智能体项目?实战指南

开发者可立即在现有系统中实施DualPath优化。首先,进行资源诊断:使用'nvidia-smi -q'查看SNIC带宽利用率,若DE网卡闲置>40%,说明有优化空间。接着配置双路径:1) 在DeepSeek V4部署时,将'path_strategy'设为'dynamic';2) 通过'rdma_qos=95'参数设置优先级;3) 启用DE缓冲区('de_buffer_size=2048')。关键步骤是监控调度器决策:当'ttft'指标持续>1.5s时,调整DE路径阈值(推荐设为55%)。例如,某医疗AI平台在接入DualPath后,将日均3000次诊断请求的处理时间从120s降至68s,节省40%GPU资源。对小型团队,建议从模拟环境开始:用'v4-1000'测试工具模拟100k token上下文,观察TTFT变化。若吞吐量提升<1.5倍,检查RDMA配置是否开启(需在/etc/modprobe.d/rdma.conf添加'rdma=1')。注意事项:避免在低延迟场景(如实时翻译)启用DE路径,因传输延迟可能>0.3ms;对于<100B模型,仅在高负载时激活。最终,将优化效果量化:记录'per_request_cost'指标,理想值应<传统架构的60%。

DualPath:为何是大模型基础设施的范式革命?

DualPath的意义远超性能优化,它标志着大模型基础设施从'算力为中心'转向'数据流动为中心'。2026年行业数据显示,72%的智能体项目受限于I/O而非计算——当GPU算力提升100%时,I/O墙导致实际性能仅提升35%。DualPath通过'资源池化'重构了硬件利用模式:闲置SNIC带宽的100%利用率,相当于免费获得50%的额外网络带宽。这将直接影响云服务成本:以AWS为例,660B模型的推理单价可从0.85美元/1000 token降至0.52美元,年节省超200万美元。更深远的是,它为多模态智能体铺平道路:当视频/图像处理加入时,I/O需求激增300%,DualPath的动态调度使系统仍能保持85%吞吐量。对开发者而言,这意味着:未来项目可优先选择支持双路径的框架(如DeepSeek V4+),并通过'network_pools'参数管理全局带宽。行业趋势显示,2026年Q3起,已有30%的云厂商将DualPath纳入基础设施。关键启示:优化I/O比堆砌GPU更经济——在相同预算下,DualPath能将智能体服务规模扩大2.5倍。

总结

2026年DeepSeek V4的DualPath框架通过颠覆性双路径设计,将闲置网卡转化为性能加速器,实测证明可突破传统I/O限制。1.87倍的吞吐量提升不仅优化了智能体推理效率,更重新定义了大模型基础设施的优化方向。开发者应立即实施资源诊断和动态调度配置,优先关注TTFT指标和SNIC利用率。这一技术对AI行业具有范式意义:当硬件升级成本激增时,智能I/O调度成为降本增效的核心路径。未来,随着RDMA网络普及,DualPath的自适应机制将推动智能体服务规模化,使大模型真正实现'高效、稳定、经济'的落地。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论