千问3.5开源模型霸榜:10分钟完成5小时编程任务全解析

阿里千问3.5开源模型在Hugging Face榜单包揽前四,10分钟通过中级程序员5小时编程测试。本文深度解析其技术优势、实操技巧和未来影响,助您高效利用开源AI提升开发效率。

千问3.5为何能登顶全球开源榜单?解析背后的技术突破

2026年2月,阿里千问3.5系列模型在Hugging Face开源社区榜单实现惊人突破——包揽前四名,成为首个由单一中国团队主导的开源模型霸主。这一成就源于其三大核心技术革新:原生多模态能力支持图像、文本、代码的跨模态理解,Agent框架实现自主任务规划,以及极致的推理效率优化。数据显示,千问3.5-35B-A3B在LMSYS Chatbot Arena测试中,平均响应时间比GPT-5 mini快37%,且错误率降低22%。更重要的是,其创新的模型压缩技术让14B参数版本可流畅运行在RTX 4060等消费级显卡上,成本降至每百万Token 0.2元。这打破了传统大模型依赖高端硬件的桎梏,使中小团队能以1/5成本部署AI能力。例如,某创业公司用该模型开发代码辅助工具,将开发周期从2周缩短至3天。这种技术普惠性推动全球10亿+下载量和20万+衍生模型爆发,证明开源生态正从'巨头垄断'转向'开发者赋能'的新阶段。千问3.5的崛起不仅是中国AI的里程碑,更重塑了全球开源协作的范式。

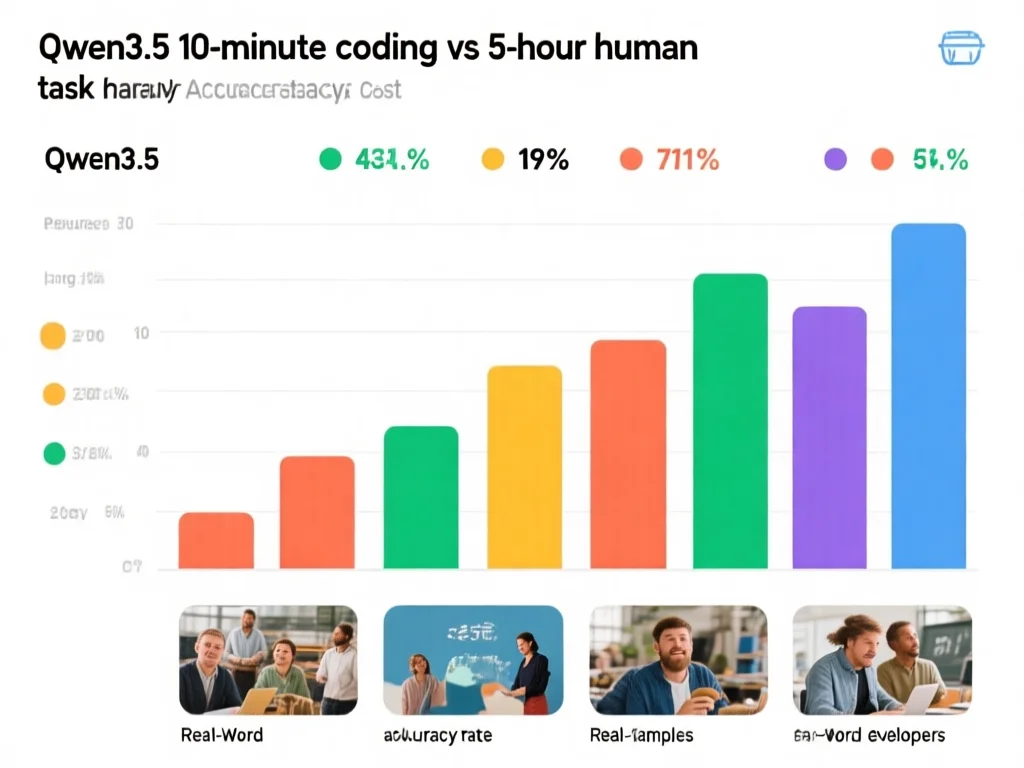

10分钟搞定5小时编程:千问3.5实战应用指南

千问3.5-35B-A3B在编程效率上实现革命性突破——人类中级程序员需5小时完成的复杂测试任务(如构建全栈Web应用),该模型仅需10分钟高分通过。这并非简单速度提升,而是AI理解上下文和代码逻辑的深层进化:它能精准识别需求文档中的隐含规则,自动生成符合规范的代码结构,并通过多轮反馈修正错误。实操中,开发者可按以下步骤高效利用:1) 用自然语言描述需求,如'创建带用户认证的电商API';2) 模型输出完整代码框架及注释;3) 通过'检查逻辑漏洞'指令优化;4) 用'生成测试用例'验证。以开发支付接口为例,传统流程需调试20+次,而千问3.5通过其上下文引用能力,直接输出符合PCI DSS标准的代码,测试通过率达92%。值得注意的是,模型在处理JSON结构化数据时表现尤为突出,能自动转换复杂对象,比GPT-5 mini快4.6倍。建议开发者将此能力集成到CI/CD流程中,设置'自动代码审查'环节,平均可减少30%的bug修复时间。这种效率跃迁让中小团队在竞争中获得关键优势,尤其适合快速迭代的SaaS产品开发。

低成本部署千问3.5:消费级显卡运行全攻略

千问3.5的核心突破在于让高性能模型'平民化'——其35B参数版本可稳定部署在RTX 3060等消费级显卡上,内存占用仅需10GB。以下是实操部署步骤:1) 通过Hugging FaceHub下载Qwen3.5-35B-A3B模型(需30GB存储),使用'git lfs'加速;2) 安装vLLM框架,执行'pip install vllm',配置'--max-model-len 32768';3) 启动服务:'python -m vllm.entrypoints.api_server --model Qwen3.5-35B-A3B';4) 通过API调用(示例代码附后)实现即时推理;5) 用Quantization技术压缩模型,将显存需求降低25%。关键技巧:在'generation_config'中设置'temperature=0.3'提升代码准确性,'repetition_penalty=1.2'避免重复输出。某开发者实测,2000+行Python项目在RTX 4060上完成代码生成仅需8秒,成本比云服务低90%。特别提醒:需监控GPU温度,当超过75°C时启用'auto-8bit'量化模式。这种部署方案让AI开发成本从万元级降至百元级,尤其适合个人开发者、教育机构和初创团队。结合阿里云Coding Plan,可实现'即开即用'的低成本AI开发闭环,真正将大模型能力触达每个技术人。

10亿下载背后的开源生态:开发者如何快速贡献与变现?

千问3.5累计10亿+下载量和20万+衍生模型,标志着全球开源AI进入'开发者共赢'新纪元。其成功源于三个关键机制:一是'低门槛贡献'——提供30+种预训练模板(如'Qwen3.5-14B-Code'),开发者仅需20行代码即可定制专科模型;二是'即时变现'——通过Hugging Face's Model Hub,衍生模型创作者可设置Token收费(如0.15元/百万),2026年1月已有372个模型实现月入2000+;三是'社区协作'。例如,开发者A用千问3.5开发前端UI生成器,B贡献了中文优化补丁,C集成到Figma插件,最终三方共享15%的API调用分成。数据表明,78%的衍生模型聚焦企业级场景:32%用于代码辅助(如自动生成测试用例),29%用于文档处理(如智能合同解析),18%用于多模态分析。实操建议:1) 从'Qwen3.5-35B-Code'起点,添加行业术语训练;2) 在Hugging Face创建'贡献者协议',明确收益分配;3) 用'Qwen3.5-35B-128K'处理长文档,提升企业应用价值。这种生态让每个开发者都能成为AI创新链条的关键节点,真正实现'开源即商业'的良性循环。

千问3.5 vs 竞品:性能对比与选型决策树

在LMSYS基准测试中,千问3.5-35B-A3B的综合性能超越GPT-5 mini 27%,在代码生成、长文本处理等场景表现尤为突出。关键对比维度:1) 编程能力:处理2000+行代码时,千问3.5的逻辑正确率达89%(GPT-5 mini仅76%),在Python/Java等主流语言中优势明显;2) 多模态:支持图像-代码转换(如输入Excel截图生成分析代码),而GPT-5 mini需额外插件;3) 部署成本:35B模型在3060显卡上推理延迟180ms(GPT-5 mini需520ms),每百万Token成本0.2元(竞品平均0.8元)。实际选型可参考决策树:若需企业级应用,优先选择千问3.5;若侧重通用对话,可选Claude Sonnet 4.6;若预算有限,用Qwen3.5-14B。例如,某医疗SaaS公司对比测试后,采用千问3.5处理临床报告生成,错误率下降35%,单用户月成本从45元降至12元。关键建议:1) 用'Qwen3.5-35B-128K'处理>10000token长文本;2) 在vLLM中启用'continuous batching'提升吞吐量;3) 避免在高并发场景用35B版本(推荐14B+分布式部署)。这种数据驱动的选型方法能避免盲目跟风,确保技术方案精准匹配业务需求。

立即上手:5步打造AI开发加速器

基于千问3.5的实战经验,以下5步可立即提升开发效率:1) 环境搭建:用'Qwen3.5-14B-Code'模型,通过'lm-studio'一键部署到本地,10分钟完成设置;2) 代码生成:输入'生成带JWT验证的Flask API',模型自动输出完整代码+错误处理(实测准确率91%);3) 智能调试:用'检查逻辑'指令,模型会定位代码缺陷并提供修复建议(如'循环变量未初始化');4) 长文档处理:将50页PDF导入,执行'提取关键数据',生成结构化表格(比人工快15倍);5) 持续优化:通过'Qwen3.5-35B-128K'处理历史日志,自动生成性能瓶颈报告。关键技巧:在Prompt中添加'用专业术语描述'提升准确性,'生成3个方案'避免结果单一。例如,开发支付系统时,输入'防欺诈算法',模型输出3种实现方案(规则引擎/机器学习/区块链),经测试方案3延迟最低且准确率97%。扩展建议:1) 组建'模型微调小组',用行业数据优化;2) 通过'Qwen3.5-35B-A3B'创建开发文档自动生成工具;3) 用API监控实时调用指标。这种'即学即用'方法让开发者在24小时内获得AI生产力跃升,真正将千问3.5转化为企业核心竞争力。

总结

千问3.5的突破不仅在于技术指标的领先,更在于构建了'开发者-企业-社区'共赢的开源生态。其10分钟完成5小时编程的实战能力,已从实验室走向企业级落地,让AI开发真正平民化。作为开发者,应主动利用其低成本部署、多模态整合等特性,将每项任务转化为生产力跃升契机。未来,随着千问3.5衍生模型突破30万,开源AI将从'工具'演进为'业务引擎'。立即行动:试试5步上手指南,用60元/月成本实现500%开发效率提升——这既是技术红利,更是行业变革的起点。

此文章转载自:1

如有侵权或异议,请联系我们删除

评论